diff --git "a/4\355\214\200_week3_\354\243\274\354\227\260\354\247\204.md" "b/4\355\214\200_week3_\354\243\274\354\227\260\354\247\204.md"

new file mode 100644

index 0000000..0e1b4b5

--- /dev/null

+++ "b/4\355\214\200_week3_\354\243\274\354\227\260\354\247\204.md"

@@ -0,0 +1,185 @@

+# **로지스틱 회귀 & 확률적 경사 하강법**

+- **head ( ) :** 처음 5개 행 출력 메소드

+- **unique( )** : 판다스의 함수. 클래스들 출력해준다

+ ``` python

+ print(pd.unique(fish['Species']))

+

+ => ['Bream', 'Roach', 'Whitefish', 'Parkki', 'Perch']

+ ```

+

+- **classes_ :** KneighborsClassifier에서 **알파벳 순으로 정렬**된 타깃값 classes_속성에 저장됨

+

+- **predict_proba( )** : 클래스별 확률값 반환 메소드

+- **round( ) :** 넘파이의 함수. 기본으로 소수점 첫째 자리에서 반올림. 그러나 decimals 이용해서 소수점 아래 자릿수 지정 가능

+ ```python

+ import numpy as np

+

+ proba = kn.predict_proba(test_scaled[:5])

+

+ print(np.round(proba, decimals = 4))

+ # 소수점 네 번째 자리까지 표기

+ => [0. 0. 0.6667 0. 0.3333 0. 0.]

+ ```

+

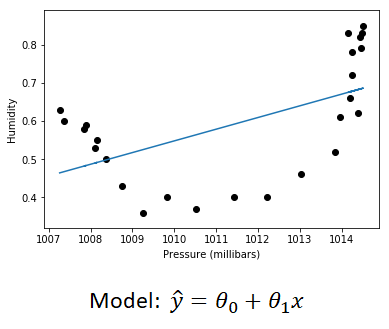

+## **로지스틱 회귀**

+---

+이름은 회귀이지만 분류 모델. 선형 방정식을 학습한다.

+

+$$

+z = a * (weight) + b *(length) + d * (height) + e *(width) + f

+$$

+

+**1.** a, b, c, d, e 는 가중치이다.

+

+**2.** z는 음수 양수 상관없이 어떤 값도 가능하다.

+

+

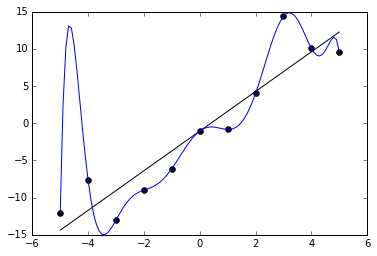

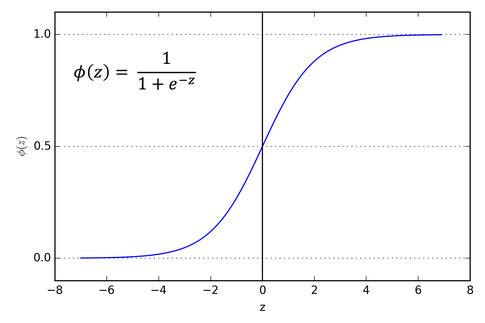

+### **시그모이드 함수 (이중분류 때 사용)**

+z가 아주 큰 양수일 때 1이, 아주 큰 음수일 때 0이 되게 해주는 함수

+

+$$

+\frac {1} {1+e^-z}

+$$

+

+시그모이드 함수 출력 > 0.5 => **양성 클래스**

+

+시그모이드 함수 출력 <= 0.5 => **음성 클래스**

+

+- **불리언 인덱싱** : True False 값 전달해서 넘파이 배열 행 선택

+ ```python

+ bream_smelt_indexes = (train_target == 'Bream') or (train_target == 'Smelt')

+

+ train_bream_smelt = train_scaled[bream_smelt_indexes]

+

+ target_bream_smelt = target_scaled[bream_smelt_indexes]

+

+ => 도미와 빙어 값만 들어있게 된다

+ ```

+

+### **로지스틱 회귀 이진 분류 훈련 방법**

+``` python

+from sklearn.linear_model import LogisticRegression

+

+lr = LogisticRegression()

+

+lr.fit(train_bream_smelt, target_bream_smelt)

+

+print(lr.predict_proba(train_bream_smelt[:5]))

+=> [[0.99759855 0.00240145]]

+

+# 첫번째 열이 음성 클래스(0)에 대한 값 _ 알파벳 순

+# 두번째 열이 양성 클래스(1)에 대한 값 _ 알파벳 순

+

+print(lr.coef_, lr.intercept_)

+=> [[-0.4037798 -0.57620209 -0.66280298 -1.01290277 -0.73168947]] [-2.16155132]

+# 각각 다 가중치(계수)이다.

+

+decision = lr.decision_function(train_bream_smelt[:5])

+

+print(decisions)

+=> [-6.02927744 3.57123907 -5.26568906 -4.24321775 -6.0607117]

+# decision_function()은 z값 구해주는 메소드

+

+from scipy.special import expit

+

+print(expit(decisions))

+=> [0.00240145 0.97264817 0.00513928 0.01415798 0.00232731]

+

+# expit(z) 는 시그모이드 함수

+```

+

+### **로지스틱 회귀 다중 분류 방법**

+

+- **max_iter** : 반복횟수 지정. 기본값은 100. 에포크 횟수 지정

+

+- 계수의 제곱을 규제( L2 규제라고도 부름)

+- **C** : 규제 제어 매개변수. 작을수록 규제 커짐. 기본값 = 1

+- 다중 분류는 클래스마다 z 값 하나씩 계산. 가장 높은 z값 출력하는 클래스가 예측 클래스

+

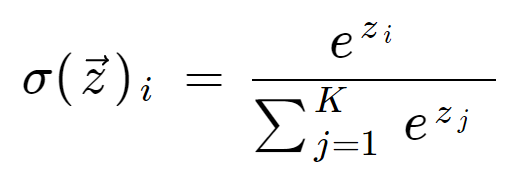

+### **소프트맥스 함수(다중 분류에 이용)**

+여러 개의 선형 방정식의 출력값을 0~1사이로 압축 후 전체 합이 1 이 되도록 만듦

+

+$$

+e_ sum = e^z1 + e^z2 + ... + e^z7

+$$

+$$

+s1 = \frac{e^z1} {e_sum},

+s7 = \frac{e^z7} {e_sum}

+$$

+7개 모두 합하면 1

+

+```python

+from scipy.special import softmax

+

+proba = softmax(decision, axis = 1)

+# axis = 1 은 각 행마다 소프트맥스 계산하라는 것

+

+print(np.round(proba, decimals = 3))

+=> [0. 0.014 0.841 0. 0.136 0.007 0.003]

+```

+

+## **점진적 학습**

+---

+

+- **점진적 학습 :** 앞서 훈련한 모델 버리지 않고 새로운 데이터에 대해서만 조금씩 더 훈련하는 것

+- **확률적 :** '무작위하게', '랜덤하게'

+

+### **확률적 경사 하강법**

+1. 대표적인 점진적 학습 알고리즘

+2. 샘플 하나씩 선택해서 경사 내려가기

+

+- **에포크 :** 훈련 세트를 한 번 모두 사용하는 과정

+

+### **미니배치 경사 하강법**

+1. 무작위 여러개 샘플 사용해서 경사 내려가기

+

+### **배치 경사 하강법**

+1. 전체 샘플 사용해서 경사 내려가기

+

+## **손실함수**

+---

+1. 어떤 문제에서 머신러닝 알고리즘이 얼마나 엉터리인지를 측정하는 기준.

+

+2. 작을수록 굿.

+3. 미분 가능해야 함.

+

+### **로지스틱 손실 함수 ( 이진 분류에 사용 )**

+---

+

+**양성 클래스일 때 손실 =** -log(예측 확률)

+

+**음성 클래스일 때 손실 =** -log(1 - 예측 확률)

+

+### **크로스엔트로피 손실 함수 ( 다중 분류에 사용 )**

+---

+- **SGDClassifier :** 사이킷런에서 확률적 경사 하강법 제공하는 대표적 분류용 클래스

+

+- **loss :** 손실 함수 종류 지정

+

+```python

+from sklearn.linear_model import SGDClassifier

+

+sc = SGDClassifier(loss = 'log', max_iter = 10, random_state = 42)

+

+# loss = 'log'이므로 클래스마다 이진 분류 모델 만듦.

+# 에포크 10회

+```

+

+### **훈련된 모델 sc추가로 훈련 시키기**

+- **partial_fit()** 메소드 사용된다

+

+```python

+sc.partial_fit(train_scaled, train_target)

+```

+호출 할 때마다 1 에포크 이어서 훈련. 전달한 훈련 세트에서 1개씩 샘플 꺼내서 경하 하강법 단계 실행

+

+### **에포크와 과대/과소적합**

+에포크 횟수 적으면 => 과소적합

+

+에포크 횟수 너무 많으면 => 과대적합

+

+```python

+sc = SGDClassifier(loss = 'log', max_iter = 100, tol = None, random_state = 42)

+```

+SGDClassifier는 일정 에포크 동안 성능 향상 없으면 더 훈련하지 않고 자동으로 멈춤.

+- **tol :** 향상될 최솟값 지정

\ No newline at end of file

diff --git "a/5\355\214\200_\355\231\251\354\235\270\354\204\234.md" "b/5\355\214\200_\355\231\251\354\235\270\354\204\234.md"

deleted file mode 100644

index 8bad254..0000000

--- "a/5\355\214\200_\355\231\251\354\235\270\354\204\234.md"

+++ /dev/null

@@ -1,51 +0,0 @@

-# Chapter 03 회귀 알고리즘과 모델 규제

-

-### 03-1 k-최근접 이웃 회귀

-- Keywords

- - **회귀**: 임의의 수치(=타깃값)를 예측하는 문제

- - **k-최근접 이웃 회귀**: 가장 가까운 이웃 샘플들의 타깃값의 평균으로 예측하는 회귀 방법

- - **결정계수(R²)**: 회귀 문제의 성능 측정 도구. $R^2=1-\frac{\sum(타깃-예측)^2}{\sum(타깃-평균)^2}$

- - **과대적합**: (모델의 성능) 훈련 세트 > 테스트 세트

- - **과소적합**: (모델의 성능) 훈련 세트 < 테스트 세트, or 둘 다 낮을 때

-

-- Packages and Functions

- - scikit-learn

- - **KNeighborsRegressor**: k-최근접 이웃 회귀 모델을 만드는 클래스

- - **mean_absolute_error()**: 회귀 모델의 평균 절댓값 오차를 계산함.

- - numpy

- - **reshape()**: 배열의 크기를 바꿈

-

- `train_input = train_input.reshape(-1, 1)`

-

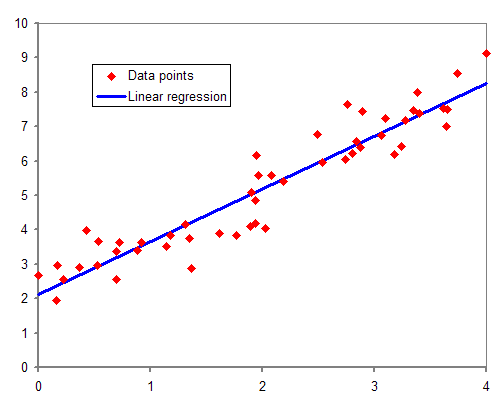

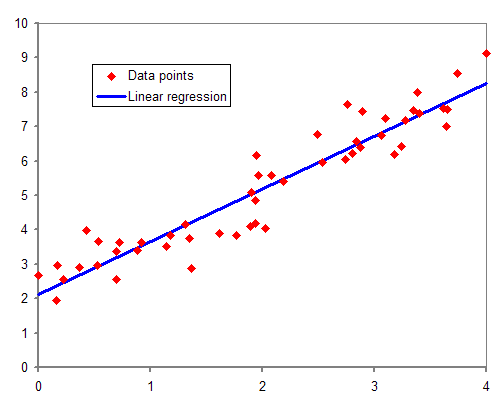

-### 03-2 선형 회귀

-- Keywords

- - **선형 회귀**: 특성과 타깃 사이의 관계를 가장 잘 나타내는 선형 방정식을 찾음.

- - **모델 파라미터**: 머신러닝 모델이 특성에서 학습한 파라미터(선형 회귀)

- - **다항 회귀**: 다항식을 사용한 선형 회귀

-

-- Packages and Functions

- - scikit-learn(.linear_model)

- - **LinearRegression**: 선형 회귀 모델을 만드는 클래스

- - **coef_** 속성: 특성에 대한 계수를 포함한 배열

- - **intercept_** 속성: 절편을 포함한 배열

-

-### 03-3 특성 공학과 규제

-- Keywords

- - **다중 회귀**: 여러 개의 특성을 사용하는 회귀 모델

- - **특성 공학**: 주어진 특성을 조합하여 새로운 특성을 만드는 작업

- - **변환기**: 특성을 만들거나 전처리하는 클래스

- - **규제**: 모델이 훈련 세트에 과대적합되지 않도록 하는 것(**릿지**와 **라쏘**는 선형 모델의 계수를 작게 만듦)

- - **하이퍼파라미터**: 머신러닝 알고리즘이 학습하지 않는 파라미터. 사람이 사전에 지정함.(릿지와 라쏘의 경우, 규제 강도 alpha 파라미터)

-

-- Packages and Functions

- - scikit-learn(.pre-processing)

- - **PolynomialFeatures**: 주어진 특성을 조합하여 새로운 특성을 만드는(변환기) 클래스.

- - **transform()**: fit() 메서드 다음에 사용되어 특성 공학을 수행함.

- - **get_feature_names()**: 특성 공학 결과가 각각 어떤 입력의 조합으로 만들어졌는지 표시함.

- - **StandardScaler**: 표준점수를 기반으로 데이터를 전처리하는(변환기) 클래스

- - scikit-learn(.linear_model)

- - **Ridge**: 릿지 회귀 모델을 훈련함.

- - **Lasso**: 라쏘 회귀 모델을 훈련함.

- - **pandas**: 데이터 분석 라이브러리

- - **read_csv()**: CSV 파일을 읽어 판다스 데이터프레임으로 변환함.

- - **to_numpy()**: 판다스 데이터프레임을 넘파이 배열로 변환함.

\ No newline at end of file

diff --git "a/week1/0\355\214\200_\355\231\215\352\270\270\353\217\231.md" "b/week1/0\355\214\200_\355\231\215\352\270\270\353\217\231.md"

new file mode 100644

index 0000000..e69de29

diff --git "a/week1/1\354\243\274\354\260\250_\352\271\200\354\203\201\353\257\274.md" "b/week1/1\354\243\274\354\260\250_\352\271\200\354\203\201\353\257\274.md"

deleted file mode 100644

index 8f17256..0000000

--- "a/week1/1\354\243\274\354\260\250_\352\271\200\354\203\201\353\257\274.md"

+++ /dev/null

@@ -1,91 +0,0 @@

-# 발표 1주차

-

----

-

-발표자 : 서현빈

-

-일자 : 2022-03-17

-

----

-

-## 내용 정리

-

-### 인공지능이란?

-

-- **인공지능** : 사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템

-

-뇌의 뉴런의 개념으로 부터 출발하여 퍼셉트론 그리고 지금의 머신러닝에 이르기까지 점점 발전해옴

-

-대표적인 인물로는 프랑크 로젠블라트 등이 있다.

-

-### 기본적인 머신러닝(빙어 vs 도미)

-

-- 흔히들 사람들은 도미와 빙어를 길이와 무게만으로 분류 가능하다.

-

-- 마찬가지로 이 문제를 산점도를 바탕으로 한 그림으로 그려 해결해볼 수 있다.

-

- ```python

- import matplotlib.pyplot as plt //그래프를 그리는 패키지

-

- plt.scatter(bream_length, bream_weight) //산점도를 그리는 함수

-

- plt.xtable('length')

-

- plt.ylable('weight)')

-

- plt.show()

-

- //도미, 빙어의 데이터를 바탕으로 산점도 그래프를 그림

-

- plt.scatter(bream_length, bream_weight)

-

- plt.scatter(smelt_length, smelt_weight)

-

- plt.xlabel('length')

-

- plt.ylabel('weight')

-

- plt.show()

- ```

-

-

-학습 데이터를 통한 2차원 데이터를 제작하고 KNeighborsClassifier클래스의 fit()메서드로 훈련을 시켜보자

-

-k-최근접 이웃 알고리즘을 이용하는 것으로 새로운 물고기가 어느분포에 가까이 있냐에 따라 물고기의 종류를 결정한다.

-

-### 머신러닝 기초

-

-- 지도학습 : 훈련하기 위한 데이터와 정답(지도자)가 존재하는 특성을 가지는 학습

- - 훈련 데이터와 평가 데이터가 완전히 똑같지 않도록 설정해야 한다.

- - 그러나 데이터를 분류할 때 랜덤으로 뽑도록 해야한다.( 샘플링 편향 방지 )

-

-- 비지도 학습 : 지도자 없이 데이터의 분포 파악 또는 변형에 초점을 맞추는 학습

-

-### 전처리 기초

-

-- numpy : 데이터의 전처리에 주로 이용되는 라이브러리

-

- ```python

- import numpy as np

- ```

-

-- 넘파이의 np.column_stack()을 이용해 전달받은 튜플을 넘파이 배열로 변환해줌.

-

- ```python

- np.column_stack(([1,2,3], [4,5,6]))

- ```

-

-- 넘파이의 np.concatenate(), np.ones, np.zeros를 통해 타깃 데이터를 생성함.

- ```python

- fish_target= np.concatenate((np.ones(35), np.zeros(14)))

- ```

-

-- np.mean은 평균을 계산하고, np.std는 표준편차를 계산함.

- ```python

- mean = np.mean(train_input, axis=0)

- std = np.std(train_input, axis=0)

- ```

-

-표준점수 = (원본 – 평균)/표준편차 train_scaled = (train_input - mean) / std

-

-테스트 세트로 평가할 때도, 샘플을 훈련 세트와 동일한 평균과 표준편차로 변환해야 평가 가 능하고, 새로운 샘플도 동일함

\ No newline at end of file

diff --git "a/week1/1\354\243\274\354\260\250_\354\236\204\354\204\270\355\233\210.md" "b/week1/1\354\243\274\354\260\250_\354\236\204\354\204\270\355\233\210.md"

deleted file mode 100644

index 508bd9c..0000000

--- "a/week1/1\354\243\274\354\260\250_\354\236\204\354\204\270\355\233\210.md"

+++ /dev/null

@@ -1,60 +0,0 @@

-# Ch 01. 나의 첫 머신러닝

-___

-## 인공지능 vs 머신러닝 vs 딥러닝

-___

->인공지능은 머신러닝을 포함하는 개념이고, 머신러닝은 딥러닝을 포함하는 개념

-- __인공지능__

- 사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템을 만드는 기술

-- __머신러닝__

- 자동으로 데이터에서 규칙을 학습하는 알고리즘을 연구

-- __딥러닝__

- 머신러닝 알고리즘 중 인공 신경망을 기반으로 한 방법들

-___

-## k-최근접 이웃 알고리즘

-___

-> 어떤 데이터에 대한 답을 구할 때 주위의 다른 데이터를 보고 정답을 구하는 알고리즘

-- 용어

- - __특성__ : 데이터의 특징

- - __산점도__ : x, y축으로 이루어진 좌표계에 x, y의 관계를 표현한 그래프

- - __훈련__ : 데이터를 통해 모델이 규칙을 학습하는 과정

- - 함수

- - fit(훈련에 사용할 특성, 정답 데이터) : 모델을 훈련하는 함수

- - predict(특성) : 학습한 모델을 통해 예측하는 함수

- - score(특성, 정답) : 모델의 성능을 측정하는 함수

-

-# Ch 02. 데이터 다루기

-___

-## 지도학습이란?

-___

->머신러닝의 세 가지 종류: 지도학습, 비지도학습, 강화학습

-

-k-최근접 이웃 알고리즘은 지도학습에 속한다.

-지도학습은 훈련 데이터를 받아서 정답을 맞히면서 학습하는 과정이다

-

-___

-## 훈련 세트와 테스트 세트

-___

-> 머신러닝의 훈련 및 성능 평가를 위한 두 가지 데이터 세트

-

-훈련에 사용한 데이터는 성능 평가로 사용하면 안된다

-- __샘플링 편향__

- - 훈련 세트와 테스트 세트가 골고루 섞이지 않아 발생하는 현상

- - 골고루 섞기 위해 __numpy__ 사용

-___

-## numpy

-___

->python의 배열 라이브러리

-- 함수

- - seed(숫자) : 난수 생성을 위한 시드값을 지정하는 함수

- - arange() : 일정 간격의 정수 또는 실수 배열을 생성하는 함수

- - shuffle() : 주어진 배열을 무작위로 섞는 함수

-___

-## 데이터 전처리

-___

->알고리즘의 정확도를 위해 특성값을 일정한 기준으로 맞추어 주는 함수

-- 용어

- - __표준점수__ : 특성값이 평균에서 표준편차의 몇배만큼 떨어져 있는지 나타내는 척도

- - z=(특성값-평균)/(표준편차)

- - __브로드캐스팅__ : 크기가 다른 numpy 배열에서 자동으로 사칙 연산을 모든 행이나 열로 확장해서 수행하는 것

-- 주의할 점

- 훈련 세트를 변환한 방식 그대로 테스트 데이터를 변환해야 한다!

\ No newline at end of file

diff --git "a/week1/1\354\243\274\354\260\250_\354\236\245\354\244\200\354\230\244.md" "b/week1/1\354\243\274\354\260\250_\354\236\245\354\244\200\354\230\244.md"

deleted file mode 100644

index c1e40d1..0000000

--- "a/week1/1\354\243\274\354\260\250_\354\236\245\354\244\200\354\230\244.md"

+++ /dev/null

@@ -1,26 +0,0 @@

-**인공지능이란?**

-사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템

-

->Ex1) 강인공지능 : 사람과 비슷한 인공지능

-

->Ex2) 약인공지능 : 사람의 일을 보조하는 인공지능

-

-**인공지능의 학습**

->1. 머신러닝 : 자동으로 데이터에서 규칙 학습하는 알고리즘 연구 분야

-

->2. 딥러닝 : 머신러닝 알고리즘 중 심층신경망을 기반으로 한 방법

-

-##데이터 시각화

-1. 라이브러리 : matplotlib.pyplot을 사용.

-2. 내장 함수 : scatter() 산점도를 그리는 함수, xtable() x축의 변수를 설정하는 함수, ytable() y축의 변수를 설정하는 함수, show() 그래프를 출력하는 함수.

-

-##알고리즘

-1. 라이브러리 : sklearn.neighobrs 중에서 KNeighborsClassifier를 사용.

-2. 설명 : 근접한 데이터를 보고 다수를 차지하는 것을 정답으로 사용하는 머신러닝.

-3. 사용법 : KNeighborsClassifier(n_neighobrs=a) 근접한 a개의 데이터를 바탕으로 판단함.

-

-##머신러닝 구현하기

-1. 데이터 : 지도 학습 기준, 훈련 데이터와 테스트 데이터가 필요하며 데이터에 샘플이 올바르게 섞여 있지 않을 경우 샘플링 편향이 발생할 수 있다. *데이터는 사이킷런의 train_test_split을 이용하여 비율에 맞게 훈련과 테스트 데이터로 나눌 수 있다.*

-2. 사용 함수 : fit()을 이용하여 훈련 데이터를 학습 시키고 score를 통해 정확도를 출력하며 predict()를 이용해 테스트 데이터를 판별한다.(이진 분류의 경우)

-3. 시각화 : 산점도를 보면 x와 y의 범위가 다름을 알 수 있다. 따라서 데이터 전처리를 통해 특성값을 일정하게 맞춰주어야한다.

-

diff --git "a/week1/1\355\214\200_\354\206\241\354\242\205\353\252\205.md" "b/week1/1\355\214\200_\354\206\241\354\242\205\353\252\205.md"

deleted file mode 100644

index c01d7c6..0000000

--- "a/week1/1\355\214\200_\354\206\241\354\242\205\353\252\205.md"

+++ /dev/null

@@ -1,76 +0,0 @@

-## 1.머신러닝이란?

-

-1. AI: 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템

-2. Machine Learning: 자동으로 규칙을 학습하는 알고리즘

-3. Deep Learning: 머신러닝의 기법중 하나로 인공 신경망을 사용하는 알고리즘

-

-> **AI >> Machine Learning >> Deep Learning**

----

-## 2. 머신러닝의 종류

-- 지도학습

- - KNN

- - 선형 회귀

- - 로지스터 회귀

- - SVM

- - 결정 트리

-- 비지도 학습

- - K-Mean

- - 주성분 분석

-- 강화 학습

-

-### 지도학습: 학습할 떄 정답이 주어지는 문제

-> 분류: 정답이 디지털적인것

-

-> 회귀: 정답이 아날로그적인것

-

-### 비지도학습: 학습할 때 정답이 주어지지 않고 데이터속에서 모델이 직접 규칙을 찾는 것

-

----

-

-## 3-1. KNN을 통한 도미 빙어 데이터 구분

-

- length = bream_length + smelt_length

- weight = bream_weight + smelt_weight

- fish_data = [[l, w] for l, w in zip(length, weight)]

-

-도미와 빙어 데이터를 합친 fish_data를 생성

-

- fish_target = [1]*35 + [0]*14

-

-도미와 빙어 데이터의 정답이 담겨있는 fish_target 생성

-

- kn = KNeighborClassifier()

- kn.fit(fish_data, fish target)

-

-KNN모델을 생성 후 학습

-

- kn.predict([[25, 150]])

- = array([0])

-

-> 올바르지 않은 값이 나온 이유?

-

-### ***weight와 length의 scale이 다르기 때문!***

-

----

-

-## 3-2. 데이터 전처리

-

-표준점수: 모든 데이터를 ***(값 - 평균) / 표준편차***로 나타내는 것

-

- mean = np.mean(train_input, axis = 0)

- std = np.std(trainn_input, axis = 0)

-

-numpy의 mean, std함수를 통해 평균, 표준편차 구하기

-

- train_scaled = (train_input - mean) / std

-

-전처리된 train_scaled값 구하기

-

- kn.fit(train_scaled, train_target)

- test_scaled = (test_input - mean) / std

- kn.score(test_scaled, test_target)

- = 1.0

-

-전처리된 훈련 샘플로 모델 재학습 후 마찬가지로 전처리된 test샘플로 score을 매기기

-

-***test 샘플을 전처리 할때는 훈련 샘플의 평균과 표준편차를 사용해야 한다!***

diff --git "a/week1/1\355\214\200_\354\230\244\353\217\231\355\233\210.md" "b/week1/1\355\214\200_\354\230\244\353\217\231\355\233\210.md"

deleted file mode 100644

index 6052c16..0000000

--- "a/week1/1\355\214\200_\354\230\244\353\217\231\355\233\210.md"

+++ /dev/null

@@ -1,145 +0,0 @@

-# KNN 알고리즘 개요

-

-- 개념 : 어떤 데이터가 주어지면 그 주변의 데이터를 살펴본 뒤 더 많은 데이터가 포함되어 있는 범주로 분류하는 방식

-- 특징 : 훈련 데이터를 저장하는 것이 훈련의 전부이다.

-

-

-

-

-

-# 혼공머신 - knn 알고리즘을 이용한 생선 분류

-

-## **데이터 살펴보기**

-

-

-

-왼쪽 영역에 분포하는 데이터가 빙어, 오른쪽 영역에 분포하는 데이터가 도미를 의미한다.

-

-앞으로 사용할 데이터를 다음과 같이 정의한다.

-

-```python

-length = bream_length + smelt_length

-weight = bream_weight + smel_weight

-

-fish_data = [[l, w]] for l,w in zip(length, weight)

-

-# 1: 도미, 2: 빙어

-# 35 개의 도미 데이터와 14개의 빙어 데이터를 사용한다.

-fish_target = [1]*35 + [0]*14

-

-```

-

-## knn 알고리즘을 이용한 도미 빙어 데이터 구분

-

-사이킷 런의 KneighborsClassifer 를 통해 knn 알고리즘을 사용할 수 있다.

-```python

-from sklearn.neighbors import KNeighborsClassifier

-

-# KNN 객체 생성

-kn = KNeighborsClassifier(n_neighbors=49)

-# fit() : 주어진 데이터로 알고리즘을 훈련

-kn.fit(fish_data, fish_target)

-# score() : 0~1 사이의 값 반환

-kn.score(fish_data, fish_target)

-```

-

-## **훈련 세트 & 데이터 세트 분리**

-

-혼공머신 Chapter1,2 에서는 다음의 두 가지 방식으로 훈련 데이터와 테스트 데이터를 분류한다.

-

-- 각 데이터의 index를 랜덤으로 정렬해서 데이터를 임의로 뽑아내는 방식으로 훈련 데이터와 테스트 데이터를 분류한다.

-- 사이킷런의 train_test_split 을 사용한다.

-

-두 번째 방식으로 데이터를 분리하는 것이 깔끔하다.

-

-```python

-from sklearn.model_selection import train_test_split

-

-train_input, test_input, train_target, test_target = train_test_split(fish_data, fish_target, random_state = 42)

-```

-

-## **데이터 학습**

-

-데이터 전처리를 거치지 않고 일단, train data / test data 분리 된 것을 훈련시켰을 때 다음과 같은 결과가 나온다.

-

-*코드*

-```python

-kn = KNeighborsClassifier()

-# train

-kn.fit(train_input, train_target)

-# test

-kn.score(test_input, test_target)

-

-# (25, 150) 특성 값을 가지는 데이터를 예측해보자.

-kn.predict([[25,150]]) >>> 결과값은 빙어(0) 를 가리킨다.

-

-# 최근접 이웃을 확인해보자.

-# import matplotlib.pyplot as plt

-plt.scatter(train_input[:, 0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-# 최근접 이웃 표시

-plt.scatter(train_input[indexes,0], train_input[indexes,1], marker='D')

-plt.show()

-```

-

-

-

-> 최근접 이웃 k = 5로 지정했을 때 과반수 이상의 3 개의 이웃이 빙어 데이터를 가리키므로 산접도 상 샘플 데이터는 도미에 가깝지만 빙어로 예측하게 된다. 이를 해결하기 위해 데이터 전처리 과정을 거쳐야 한다.

-

-

-

-## **데이터 전처리**

-

-z-표준점수 정규화 방법을 사용한다. 즉, 다음의 수식을 활용한다.

-

-$$z = \frac{자료 값 - 평균}{표준편차}$$

-

-*코드*

-```python

-# 평균, 표준편차

-# import nupmy as np

-mean = np.mean(train_input, axis=0)

-std = np.std(train_input, axis=0)

-

-# 전처리 데이터

-train_scaled = (train_input - mean) / std

-

-# 전처리 데이터로 모델 훈련

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-# 전처리 데이터와 마찬가지로 테스트 데이터도 전처리 해야됨.

-plt.scatter(25, 150,marker='^')

-plt.show()

-```

-*결과*

-

-

-> 빙어 데이터 와 샘플 데이터의 차이가 뚜렷해졌다.

-

-

-## **전처리 데이터로 모델 훈련**

-

-*코드*

-```python

-new_sample_scaled = ([25, 150] - mean) / std

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1])

-

-# 최근접 이웃 표시

-distances, indexes = kn.kneighbors([new_sample_scaled])

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1], marker='^')

-plt.scatter(train_scaled[indexes, 0], train_scaled[indexes, 1], marker='D')

-plt.show()

-

-```

-

-*결과*

-

-

-

-최근접 이웃 모두 도미 데이터 이미로 샘플 데이터 역시 '도미' 로 예측하게 된다.

-

-```python

-print(kn.predict([new_sample_scaled]))

->>> [1]

-```

diff --git "a/week1/1\355\214\200_\354\235\264\354\204\261\354\247\204.md" "b/week1/1\355\214\200_\354\235\264\354\204\261\354\247\204.md"

deleted file mode 100644

index 9fd9172..0000000

--- "a/week1/1\355\214\200_\354\235\264\354\204\261\354\247\204.md"

+++ /dev/null

@@ -1,665 +0,0 @@

-# 2022년 3월 17일 HAI 혼공머신 스터디 1조 발표

-### 발표자: 임정섭

-

-## __Contents__

-### Chapter 1

-- 인공지능 / 머신러닝 / 딥러닝 이란?

-- 왜 머신러닝인가?

-- 지도학습과 비지도 학습

-

-### Chapter 2

-- 머신러닝 예제(KNN 알고리즘을 이용한 생선 분류)

-

-

-

-## Chapter 1

-### 인공지능 / 머신러닝 / 딥러닝 이란?

-- 인간의 지능을 모방하는 기술 분야인 인공지능과 기계가 학습하는 과정을 통해 이를 구현하는 머신 러닝, 그리고 인공 신경망을 이용한 머신러닝 기법인 딥러닝이 있습니다.

-### 왜 머신러닝인가?

-- 결정에 필요한 로직이 한 분야, 작업에 한정되고, 규칙을 설계하려면 그 분야의 전문가들이 내리는 결정 방식에 대해 잘 알아야 합니다.

-### 지도학습과 비지도 학습

-- 지도 학습의 종류: KNN, 로지스틱 회귀, 신경망, 선형 회귀, SVM, 결정 트리

-- 비지도 학습의 종류: K-Mean, 주성분 분석

-- 이 외에도 강화 학습 등 다양한 종류가 있습니다.

-

-

-

-## Chapter 2

-### 머신러닝 예제(KNN 알고리즘을 이용한 생선 분류)

-

-#### 이 챕터에서는 사이킷런을 이용한 첫 머신 러닝 프로그램을 구현하는 과정을 설명합니다.

-

-

-

-### 1. 개발 환경 구축

----

-- 개발 환경으로는 손쉽게 머신 러닝 프레임워크를 구동하기 위해 Google Colab을 사용했습니다.

-- 프로젝트에 사용될 언어는 Python이며 Numpy, Matplotlib, Scikits-learn 라이브러리가 사용되었습니다.

-

-### 2. KNN 알고리즘 소개

----

-- KNN 알고리즘은 주어진 데이터가 있을 때 새로운 데이터의 라벨을 예측하는 회귀 알고리즘 중 하나입니다.

-- 새로운 데이터가 주어지면, 거리가 가장 가까운 몇 개의 데이터를 살펴본 뒤 가장 많은 데이터가 포함된 라벨이 새로운 데이터의 라벨이 됩니다.

-- 따로 훈련이 필요하지 않고, 데이터를 저장하는 과정이 전부라는 특징이 있습니다.

-

-### 3. 데이터 다루기 및 시각화

----

-- 이 프로젝트에서는 도미와 빙어라는 두 종류의 생선들의 데이터를 입력받아 새로 추가된 생선이 도미인지 빙어인지 구분하는 프로그램을 작성합니다.

-- 각 생선들은 길이와 무게라는 두 개의 특성을 지니고 있습니다.

-- matplotlib.pyplot을 이용하여 그래프 형태료 표현해볼 수 있습니다.

-- 도미를 찾는것을 1로, 빙어를 0으로 정의하여 라벨 데이터도 생성합니다.

-

-### 4. sklearn을 이용한 KNN 알고리즘

----

-- skleanr.neighbors에 포함된 KNeighborsClassifier 클래스를 활용합니다.

-- fit() 함수를 활용해 주어진 데이터로 알고리즘을 훈련시킵니다.

-- n_neighbors 파라미터를 조정하는 것을 통해 얼마나 많은 이웃들을 고려할지 정할 수 있습니다.

-

-### 5. 훈련 데이터와 테스트 데이터

----

-- 어떤 머신러닝 모델을 훈련할 때, 모든 데이터로 훈련시키는 것 보다는 전체 데이터에서 일부분을 테스트 데이터로 구분하여 훈련 과정에서 완전히 배제시키고 훈련이 끝난 모델에서 모델의 성능을 평가하는 방식으로 사용됩니다.

-- 이 프로젝트에서는 전체 데이터의 약 25%를 균일하게 뽑아서 테스트 데이터로 사용했습니다.

-

-### 6. 데이터 전처리

----

-- 도미와 빙어의 성질인 길이와 무게는 단위와 데이터 분포가 다르기 때문에 상대적으로 숫자가 더 큰 무게가 KNN 알고리즘에서 더 중요한 성질처럼 학습될 수 있습니다.

-- 그래서 무게와 길이 데이터를 각각 평균을 빼고 표준편차로 나누어 정규화하면 각각의 데이터가 편중되지 않게 반영될 수 있습니다.

-- 여기서 주의해야 할 점은 테스트 데이터의 성질이 훈련 과정에 반영되면 안 되기 때문에, 테스트 데이터를 전처리할 때에도 훈련 데이터의 성질(평균, 표준편차)를 사용해야 합니다.

-

-### __아래는 이번주 발표자분이 작성한 프로그램 실행 과정입니다.__

-

----

-

-

-

-# 혼공머신 1.3장 예제 - KNN 알고리즘을 이용한 생선 분류

-

-

-## 예제 데이터 준비

-

-

-```python

-# 도미 Data

-#특성1. 길이

-bream_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0,

- 31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0,

- 35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0]

-#특성2. 무게

-bream_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0,

- 500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0,

- 700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0]

-# 빙어 Data

-smelt_length = [9.8, 10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

-smelt_weight = [6.7, 7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9]

-```

-

-## matplotlib 을 이용한 데이터 그래프 표현

-

-

-```python

-import matplotlib.pyplot as plt

-# 산점도 그래프 생성

-plt.scatter(bream_length, bream_weight)

-plt.scatter(smelt_length, smelt_weight)

-# x축

-plt.xlabel('length')

-# y축

-plt.ylabel('weight')

-plt.show()

-

-```

-

-

-## KNN 알고리즘을 이용한 도미 빙어 데이터 구분

-

-

-```python

-# 데이터 합치기

-length = bream_length + smelt_length

-weight = bream_weight + smelt_weight

-

-fish_data = [[l, w] for l,w in zip(length,weight)]

-print(fish_data)

-```

-

- [[25.4, 242.0], [26.3, 290.0], [26.5, 340.0], [29.0, 363.0], [29.0, 430.0], [29.7, 450.0], [29.7, 500.0], [30.0, 390.0], [30.0, 450.0], [30.7, 500.0], [31.0, 475.0], [31.0, 500.0], [31.5, 500.0], [32.0, 340.0], [32.0, 600.0], [32.0, 600.0], [33.0, 700.0], [33.0, 700.0], [33.5, 610.0], [33.5, 650.0], [34.0, 575.0], [34.0, 685.0], [34.5, 620.0], [35.0, 680.0], [35.0, 700.0], [35.0, 725.0], [35.0, 720.0], [36.0, 714.0], [36.0, 850.0], [37.0, 1000.0], [38.5, 920.0], [38.5, 955.0], [39.5, 925.0], [41.0, 975.0], [41.0, 950.0], [9.8, 6.7], [10.5, 7.5], [10.6, 7.0], [11.0, 9.7], [11.2, 9.8], [11.3, 8.7], [11.8, 10.0], [11.8, 9.9], [12.0, 9.8], [12.2, 12.2], [12.4, 13.4], [13.0, 12.2], [14.3, 19.7], [15.0, 19.9]]

-

-

-

-```python

-# 1 : 도미 / 2: 빙어

-fish_target = [1]*35 + [0]*14

-print(fish_target)

-```

-

- [1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0]

-

-

-

-```python

-from sklearn.neighbors import KNeighborsClassifier

-```

-

-

-```python

-# KNN 객체 생성

-kn = KNeighborsClassifier()

-# fit() : 주어진 데이터로 알고리즘을 훈련

-kn.fit(fish_data, fish_target)

-# score() : 0~1 사이의 값 반환

-kn.score(fish_data, fish_target)

-```

-

-

-

-

- 1.0

-

-

-

-

-```python

-# predict

-kn.predict([[30,600]]) , kn.predict([[10,100]]) # (array([1]), array([0]))

-```

-

-

-

-

- (array([1]), array([0]))

-

-

-

-

-```python

-# n_neighbors

-kn49 = KNeighborsClassifier(n_neighbors=49)

-kn49.fit(fish_data, fish_target)

-print(kn49.score(fish_data, fish_target))

-print(35/49)

-```

-

- 0.7142857142857143

- 0.7142857142857143

-

-

-

-```python

-kn49.predict([[10, 100]])

-```

-

-

-

-

- array([1])

-

-

-

-

-```python

-plt.scatter(25, 500, marker='^')

-# 산점도 그래프 생성

-plt.scatter(bream_length, bream_weight)

-plt.scatter(smelt_length, smelt_weight)

-# x축

-plt.xlabel('length')

-# y축

-plt.ylabel('weight')

-plt.show()

-```

-

-

-

-

-

-## 훈련 세트 & 테스트 세트

-

-

-```python

-import numpy as np

-```

-

-#### Numpy vs List 속도 비교

-

-

-```python

-my_arr = np.arange(1000000)

-my_list = list(range(1000000))

-%time for _ in range(10): my_arr2 = my_arr * 2

-%time for _ in range(10): my_list2 = [x * 2 for x in my_list]

-```

-

- CPU times: user 14.1 ms, sys: 5.32 ms, total: 19.4 ms

- Wall time: 22.6 ms

- CPU times: user 763 ms, sys: 190 ms, total: 953 ms

- Wall time: 957 ms

-

-

-#### Numpy를 이용한 데이터 표현

-

-

-```python

-input_arr = np.array(fish_data)

-target_arr = np.array(fish_target)

-print(input_arr)

-print(target_arr)

-```

-

- [[ 25.4 242. ]

- [ 26.3 290. ]

- [ 26.5 340. ]

- [ 29. 363. ]

- [ 29. 430. ]

- [ 29.7 450. ]

- [ 29.7 500. ]

- [ 30. 390. ]

- [ 30. 450. ]

- [ 30.7 500. ]

- [ 31. 475. ]

- [ 31. 500. ]

- [ 31.5 500. ]

- [ 32. 340. ]

- [ 32. 600. ]

- [ 32. 600. ]

- [ 33. 700. ]

- [ 33. 700. ]

- [ 33.5 610. ]

- [ 33.5 650. ]

- [ 34. 575. ]

- [ 34. 685. ]

- [ 34.5 620. ]

- [ 35. 680. ]

- [ 35. 700. ]

- [ 35. 725. ]

- [ 35. 720. ]

- [ 36. 714. ]

- [ 36. 850. ]

- [ 37. 1000. ]

- [ 38.5 920. ]

- [ 38.5 955. ]

- [ 39.5 925. ]

- [ 41. 975. ]

- [ 41. 950. ]

- [ 9.8 6.7]

- [ 10.5 7.5]

- [ 10.6 7. ]

- [ 11. 9.7]

- [ 11.2 9.8]

- [ 11.3 8.7]

- [ 11.8 10. ]

- [ 11.8 9.9]

- [ 12. 9.8]

- [ 12.2 12.2]

- [ 12.4 13.4]

- [ 13. 12.2]

- [ 14.3 19.7]

- [ 15. 19.9]]

- [1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 0 0

- 0 0 0 0 0 0 0 0 0 0 0 0]

-

-

-

-```python

-# random 으로 data 뽑기

-# seed 값 설정 시 일정한 random 값 생성

-np.random.seed(3)

-index = np.arange(49)

-np.random.shuffle(index)

-print(index)

-```

-

- [12 39 9 46 31 28 13 47 44 6 36 23 37 18 4 25 16 15 30 11 7 40 27 34

- 45 5 48 1 35 2 22 33 17 26 14 29 20 32 38 43 41 10 19 21 0 8 3 24

- 42]

-

-

-

-```python

-# train_data 생성하기

-train_input = input_arr[index[:35]]

-train_target = target_arr[index[:35]]

-

-# test_data 생성하기

-test_input = input_arr[index[35:]]

-test_target = target_arr[index[35:]]

-```

-

-

-```python

-plt.scatter(train_input[:,0], train_input[:,1])

-plt.scatter(test_input[:,0], test_input[:,1])

-plt.show()

-```

-

-

-

-

-

-```python

-# KNN 알고리즘으로 test_data 대입해보기

-kn = kn.fit(train_input, train_target)

-kn.score(test_input,test_target)

-```

-

-

-

-

- 1.0

-

-

-

-

-```python

-kn.predict([[20, 250]])

-```

-

-

-

-

- array([1])

-

-

-

-## 데이터 전처리

-

-

-```python

-# np.column_stack 을 이용한 fish_data 생성

-

-fish_data = np.column_stack((length, weight))

-print(fish_data[:10])

-```

-

- [[ 25.4 242. ]

- [ 26.3 290. ]

- [ 26.5 340. ]

- [ 29. 363. ]

- [ 29. 430. ]

- [ 29.7 450. ]

- [ 29.7 500. ]

- [ 30. 390. ]

- [ 30. 450. ]

- [ 30.7 500. ]]

-

-

-

-```python

-# np.zeros(), np.ones() : 0, 1 행렬 생성

-# fish_target

-fish_target = np.concatenate((np.ones(35), np.zeros(14)))

-print(fish_target)

-```

-

- [1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1.

- 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 1. 0. 0. 0. 0. 0. 0. 0. 0. 0. 0. 0. 0. 0.

- 0.]

-

-

-### 사이킷런으로 훈련 데이터와 테스트 데이터 나누기

-

-

-```python

-from sklearn.model_selection import train_test_split

-```

-

-

-```python

-train_input, test_input, train_target, test_target = train_test_split(fish_data, fish_target, random_state = 42)

-print(train_input, test_input, train_target, test_target)

-```

-

- [[ 30. 450. ]

- [ 29. 363. ]

- [ 29.7 500. ]

- [ 11.3 8.7]

- [ 11.8 10. ]

- [ 13. 12.2]

- [ 32. 600. ]

- [ 30.7 500. ]

- [ 33. 700. ]

- [ 35. 700. ]

- [ 41. 975. ]

- [ 38.5 920. ]

- [ 25.4 242. ]

- [ 12. 9.8]

- [ 39.5 925. ]

- [ 29.7 450. ]

- [ 37. 1000. ]

- [ 31. 500. ]

- [ 10.5 7.5]

- [ 26.3 290. ]

- [ 34. 685. ]

- [ 26.5 340. ]

- [ 10.6 7. ]

- [ 9.8 6.7]

- [ 35. 680. ]

- [ 11.2 9.8]

- [ 31. 475. ]

- [ 34.5 620. ]

- [ 33.5 610. ]

- [ 15. 19.9]

- [ 34. 575. ]

- [ 30. 390. ]

- [ 11.8 9.9]

- [ 32. 600. ]

- [ 36. 850. ]

- [ 11. 9.7]] [[ 32. 340. ]

- [ 12.4 13.4]

- [ 14.3 19.7]

- [ 12.2 12.2]

- [ 33. 700. ]

- [ 36. 714. ]

- [ 35. 720. ]

- [ 35. 725. ]

- [ 38.5 955. ]

- [ 33.5 650. ]

- [ 31.5 500. ]

- [ 29. 430. ]

- [ 41. 950. ]] [1. 1. 1. 0. 0. 0. 1. 1. 1. 1. 1. 1. 1. 0. 1. 1. 1. 1. 0. 1. 1. 1. 0. 0.

- 1. 0. 1. 1. 1. 0. 1. 1. 0. 1. 1. 0.] [1. 0. 0. 0. 1. 1. 1. 1. 1. 1. 1. 1. 1.]

-

-

-### 수상한 도미 한마리

-

-

-```python

-kn = KNeighborsClassifier()

-# train

-kn.fit(train_input, train_target)

-# test

-kn.score(test_input, test_target)

-```

-

-

-

-

- 1.0

-

-

-

-

-```python

-# sample predict

-print(kn.predict([[25,150]]))

-```

-

- [0.]

-

-

-

-```python

-plt.scatter(train_input[:, 0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-plt.show()

-```

-

-

-

-

-

-

-```python

-# 최근접 이웃의 거리 및 index

-distances, indexes = kn.kneighbors([[25, 150]])

-print(indexes)

-print(distances)

-```

-

- [[12 29 5 19 4]]

- [[ 92.00086956 130.48375378 138.32150953 140.00603558 140.62090883]]

-

-

-

-```python

-plt.scatter(train_input[:, 0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-# 최근접 이웃 표시

-plt.scatter(train_input[indexes,0], train_input[indexes,1], marker='D')

-plt.show()

-```

-

-

-

-

-

-## 데이터 전처리 : x축, y축 기준 맞추기

-

-

-```python

-#평균, 표준편차

-mean = np.mean(train_input, axis=0)

-std = np.std(train_input, axis=0)

-

-print(mean, std)

-```

-

- [ 26.175 418.08888889] [ 10.21073441 321.67847023]

-

-

-

-```python

-# 전처리 데이터

-train_scaled = (train_input - mean) / std

-```

-

-### 전처리 데이터로 모델 훈련하기

-

-

-

-```python

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-# 전처리 데이터와 마찬가지로 테스트 데이터도 전처리 해야됨.

-plt.scatter(25, 150,marker='^')

-plt.show()

-```

-

-

-

-

-

-

-```python

-new_sample_scaled = ([25, 150] - mean) / std

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1])

-plt.show()

-```

-

-

-

-

-

-

-```python

-test_scaled = (test_input - mean) / std

-kn.fit(train_scaled, train_target)

-print(kn.score(test_scaled, test_target))

-print(kn.predict([new_sample_scaled]))

-```

-

- 1.0

- [1.]

-

-

-

-```python

-distances, indexes = kn.kneighbors([new_sample_scaled])

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1], marker='^')

-plt.scatter(train_scaled[indexes, 0], train_scaled[indexes, 1], marker='D')

-plt.show()

-```

-

-

-

-

-

-## 결정경계

-

-### 외부 라이브러리 불러오기

-

-

-```python

-import os, sys

-from google.colab import drive

-drive.mount('/content/drive')

-

-my_path = '/content/notebooks'

-# Colab Notebooks 안에 my_env 폴더에 패키지 저장

-#os.symlink('/content/drive/My Drive/Colab Notebooks/my_env', my_path)

-sys.path.insert(0, my_path)

-```

-

- Drive already mounted at /content/drive; to attempt to forcibly remount, call drive.mount("/content/drive", force_remount=True).

-

-

-### mglearn 라이브러리를 사용하여 결정경계 확인

-

-

-

-```python

-import mglearn

-```

-

-

-```python

-mglearn.plots.plot_2d_separator(kn, train_scaled, fill=True, eps=0.5, alpha=0.5)

-mglearn.discrete_scatter(train_scaled[:,0], train_scaled[:,1], train_target)

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1], marker='D')

-plt.show()

-```

-

-

-

-

-

-## 최적의 K 찾기

-

-

-```python

-# 훈련 정확도와 테스트 정확도를 저장할 리스트 선언

-training_accuracy = []

-testing_accuracy = []

-

-# neighbor 1~36 세팅

-neighbor_settings = range(1,37)

-for n_neighbor in neighbor_settings:

- kn = KNeighborsClassifier(n_neighbors=n_neighbor)

- kn.fit(train_input, train_target)

- training_accuracy.append(kn.score(train_input, train_target))

- testing_accuracy.append(kn.score(test_input, test_target))

-plt.plot(neighbor_settings, training_accuracy, label = '훈련 정확도')

-plt.plot(neighbor_settings, testing_accuracy, label = '테스트 정확도')

-plt.show()

-print(f'훈련 데이터에서 최적의 k 는 {training_accuracy.index(max(training_accuracy)) + 1}')

-print(f'테스트 데이터에서 최적의 k 는 {testing_accuracy.index(max(training_accuracy)) + 1}')

-

-

-```

-

-

-

-

- 훈련 데이터에서 최적의 k 는 1

- 테스트 데이터에서 최적의 k 는 1

-

diff --git "a/week1/1\355\214\200_\354\236\204\354\240\225\354\204\255.md" "b/week1/1\355\214\200_\354\236\204\354\240\225\354\204\255.md"

deleted file mode 100644

index ee4aeb9..0000000

--- "a/week1/1\355\214\200_\354\236\204\354\240\225\354\204\255.md"

+++ /dev/null

@@ -1,367 +0,0 @@

-## 혼공머신 1장, 2장 정리

-

-### 1\. 인공지능 / 머신러닝 / 딥러닝 이란?

-

-#### 인공지능

-

-인공지능은 사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템을 만드는 기술이다. 인공지능은 과거 암흑기를 거쳐 최근 컴퓨터 하드웨어의 발전으로 다시 한 번 각광받기 시작한다. 인공지능에는 강인공지능(인공일반지능)과 약인공지능으로 구분할 수 있다. 강인공지능은 사람과 구별하기 어려운 높은 레벨의 시스템이고, 약인공지능은 특정 분야에 특화되어 보조 역할을 하는 시스템이다.

-

-#### 머신러닝

-

-머신러닝은 규칙을 사람이 일일이 정하지 않고 자동으로 데이터에서 규칙을 학습하는 알고리즘을 연구하는 분야이다. 인공 지능의 하위 분야인 지능을 구현하기 위한 핵심 분야이다.

-

-#### 딥러닝

-

-딥 러닝은 학습하는 많은 방법 중 하나(머신 러닝의 하위 개념)이다. 딥 러닝은 신경망 학습으로, 인간이 결론을 내리는 방식과 유사한 논리 구조를 사용하여 데이터를 지속적으로 분석한다.

-

----

-

-### 2\. 왜 머신러닝인가?

-

-그렇다면 왜 머신러닝을 이용하여 규칙을 찾아야할까? '사람이 직접 규칙을 입력해서 프로그래밍을 만들면 되는 것 아닌가'라는 생각을 할 수 있지만 이런 경우 두 가지 단점이 생긴다.

-

-- 결정에 필요한 로직이 한 분야 or 작업에 국한됨.

-- 규칙을 설계하려면 그 분야 전문가들이 내리는 결정 방식에 대해 잘 알아야 한다.

-

-얼굴 인식을 예시로 들 수 있다. 컴퓨터가 인식하는 픽셀 방식이 사람이 얼굴을 인식하는 방법과 매우 다르기 때문에 사람이 직접 디지털 이미지에서 얼굴을 구성하는 것이 무엇인지를 일련의 규칙으로 표현하기가 근본적으로 불가능하다. 그러나 머신 러닝을 사용하여 알고리즘에 많은 얼굴 이미지를 제공하면 얼굴을 특정 요소(규칙)가 무엇 인지를 찾아낼 수 있다.

-

----

-

-### 3\. 지도학습 과 비지도 학습

-

-#### 지도학습

-

-지도학습이란 정답을 알려주면서 진행하는 학습이다. 학습 시 데이터와 함께 레이블(정답)이 항상 제공되어야 한다. 지도 학습의 예로는 분류와 회귀가 대표적이다. 대표적인 알고리즘으로 KNN , SVM, 선형 회귀, 로지스터 회귀, 신경망, 결정 트리가 있다.

-

-**장점**

-

-테스트할 때 데이터와 함께 제공하기 때문에 손쉽게 모델의 성능을 평가할 수 있다.

-

-**단점**

-

-데이터마다 레이블을 달기 위해 많은 시간을 투자해야한다.

-

-#### 비지도학습

-

-비지도학습이란 레이블 없이 데이터만 입력하여 진행하는 학습이다. 보통 데이터 자체에서 패턴을 찾아낼 때 사용한다. 비지도학습의 대표적인 예로는 군집화와 차원축소가 있다. 대표적인 알고리즘으로는 K-Mean, 주성분 분석이 있다.

-

-**장점**

-

-레이블을 제공할 필요가 없다.

-

-**단점**

-

-레이블이 없기 때문에 모델 성능을 평가하는 데에 어려움이 있다.

-

----

-

-### 4\. 머신러닝 예제 (KNN을 이용한 생선 분류)

-

-#### Colab 시작하기

-

-Colab은 구글에서 제공하는 서비스로, 웹브라우저에서 무료로 파이썬 프로그램을 테스트하고 저장할 수 있다. 이는 대화식 프로그래밍 환경인 주피터 노트북을 커스터마이징한 것이다. 구글의 클라우드와 연결되어 있기 때문에 초기 세팅(라이브러리 설치 등)이 필요 없고 컴퓨터 성능과 상관없이 프로그램을 실습할 수 있다.

-

-Colab 에는 코드 셀과 텍스트 셀을 지원한다. 코드 셀은 말 그대로 코드를 입력해서 바로 실행할 수 있다. (셀은 코랩에서 실행할 수 있는 최소 단위) 그리고 텍스트 셀은 마크다운 형식으로 주석처럼 사용가능하다.

-

-#### KNN이란?

-

-KNN 알고리즘은 가장 간단한 머신러닝 알고리즘으로, 훈련 데이터셋을 저장하여 모델을 만드는 과정이 전부이다. 새로운 입력 데이터에 대해 예측할 때, 알고리즘이 훈련 데이터셋에서 가장 가까운 데이터 포인터, '최근접 이웃'을 찾는다.

-

-#### 예제 데이터 준비하기

-

-```

-# 도미 Data

-#특성1. 길이

-bream_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0,

- 31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0,

- 35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0]

-#특성2. 무게

-bream_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0,

- 500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0,

- 700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0]

-# 빙어 Data

-smelt_length = [9.8, 10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

-smelt_weight = [6.7, 7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9]

-```

-

-\* [데이터 출처](http://bit.ly/bream_list)

-

-예제의 데이터는 도미와 빙어 2 클래스(품종)로 이루어졌고 특성으로는 길이와 무게이다. (도미 sample 35개, 빙어 sample 14개)

-

-#### Matplotlib 으로 데이터 시각화하기

-

-맷플롯립 라이브러리를 이용하여 산점도 그래프를 그려보자.

-

-```

-import matplotlib.pyplot as plt

-# 산점도 그래프 생성

-plt.scatter(bream_length, bream_weight)

-plt.scatter(smelt_length, smelt_weight)

-# 예측 데이터 추가

-plt.scatter(25, 500, marker='^')

-# x축

-plt.xlabel('length')

-# y축

-plt.ylabel('weight')

-plt.show()

-```

-

-#### 데이터 다루기

-

-```

-length = bream_length + smelt_length

-weight = bream_weight + smelt_weight

-

-fish_data = [[l, w] for l,w in zip(length,weight)]

-print(fish_data)

-```

-

-파이썬의 리스트를 이용하여 도미와 빙어 길이와 무게 데이터를 각각 합친다. zip() 메서드는 나열된 리스트에서 원소를 하나씩 꺼내준다.

-

-#### 레이블 만들기

-

-```

-# 1 : 도미 / 2: 빙어

-fish_target = [1]*35 + [0]*14

-print(fish_target)

-```

-

----

-

-이제 본격적으로 sklearn 의 knn 알고리즘을 이용하여 데이터를 훈련시키고 예측해보자.

-

-#### 모델 생성 / 데이터 훈련 / 성능 측정 / 데이터 예측

-

-```

-from sklearn.neighbors import KNeighborsClassifier

-# KNN 객체 생성

-kn = KNeighborsClassifier()

-# fit() : 주어진 데이터로 알고리즘을 훈련

-kn.fit(fish_data, fish_target)

-# score() : 0~1 사이의 값 반환

-kn.score(fish_data, fish_target)

-# predict

-kn.predict([[30,600]]) , kn.predict([[10,100]]) # (array([1]), array([0]))

-```

-

-KNeighborsClassifier 객체는 KNN 알고리즘을 사용하기 위한 다양한 메서드를 포함하고 있다. 대표적으로 fit(), score(), predict() 등이 있다.

-

-#### n_neighbors

-

-KNN은 최근접 이웃을 찾을 때 n_neighbors를 통해 이웃을 몇 개나 찾을지 정할 수 있다. default 값은 5이다. n_neighbors 가 49(전체 데이터 수) 인 모델을 만들어보자.

-

-```

-# n_neighbors

-kn49 = KNeighborsClassifier(n_neighbors=49)

-kn49.fit(fish_data, fish_target)

-print(kn49.score(fish_data, fish_target))

-print(35/49)

-```

-

-n-neighbors=49 로 정하면 전체 데이터 수와 같기 때문에 데이터를 예측할 때 항상 도미로 분류한다.

-

----

-

-#### 훈련 세트 & 테스트 세트

-

-위 예제에서는 데이터 셋 구분 없이 전체 데이터를 학습시키고 정확도를 평가했다. 여기서 문제가 발생하는데, 훈련시킨 데이터를 테스트 데이터로 사용했기 때문에 정확성을 신뢰할 수 없다. (마치 정답을 미리 알려주고 시험을 보는 것과 같다.) 또한, 전체 데이터로 훈련시키면 정확한 평가를 위해 전체 데이터 외에 추가적인 데이터가 필요하다.

-

-그래서 데이터 셋이 있을 때 훈련 세트(데이터)와 테스트 세트(데이터)로 나눠서 모델을 생성하고 평가한다. 일반적으로 훈련 세트는 데이터 셋의 75%, 테스트 세트는 데이터 셋의 25% 로 설정하여 진행한다.

-

-#### Numpy 을 이용한 데이터 다루기

-

-이번에는 Numpy의 ndarray 를 이용해 데이터를 만들어보자.

-

-```

-import numpy as np

-input_arr = np.array(fish_data)

-target_arr = np.array(fish_target)

-print(input_arr)

-print(target_arr)

-```

-

-#### 샘플링 편향

-

-위 데이터는 index 0

-

-~34 까지는 도미 데이터, 35~

-

-48 까지는 빙어 데이터로 되어있다. 이처럼 훈련 세트와 테스트 세트에 샘플이 골고루 섞여 있지 않으면 샘플링이 한쪽으로 치우친 것을 샘플링 편향이라고 한다. 위 데이터는 샘플링 편향이 있기 때문에 앞 데이터를 가지고 훈련하고 뒤에 있는 데이터로 테스트하면 결과값이 도미로만 출력되는 문제가 있다. 이러한 문제를 해결하기 위해 무작위로 데이터를 섞을 필요가 있다. numpy 의 random 클래스를 이용해서 도미와 빙어가 골고루 섞인 데이터를 만들어보자.

-

-```

-# random 으로 data 뽑기

-# seed 값 설정 시 일정한 random 값 생성

-np.random.seed(3)

-index = np.arange(49)

-np.random.shuffle(index)

-print(index)

-```

-

-#### 훈련 데이터 / 테스트 데이터 생성 및 성능 평가

-

-우선, 훈련 데이터 개수를 35개, 테스트 데이터를 14개로 설정하겠습니다.

-

-```

-# train_data 생성하기

-train_input = input_arr[index[:35]]

-train_target = target_arr[index[:35]]

-

-# test_data 생성하기

-test_input = input_arr[index[35:]]

-test_target = target_arr[index[35:]]

-```

-

-다음으로 훈련 데이터와 테스트 데이터를 시각화 해보자.

-

-```

-plt.scatter(train_input[:,0], train_input[:,1])

-plt.scatter(test_input[:,0], test_input[:,1])

-plt.show()

-```

-

-이제 모델 성능 테스트를 해보자.

-

-```

-# KNN 알고리즘으로 test_data 대입해보기

-kn = kn.fit(train_input, train_target)

-kn.score(test_input,test_target)

-```

-

-1.0 이라는 100% 정확성 결과를 얻었다.

-

----

-

-### 5\. 데이터 전처리

-

-#### 사이킷런으로 훈련 데이터와 테스트 데이터 나누기

-

-위에서 random 함수를 이용하여 훈련 데이터와 테스트 데이터를 나눴다. 이 기능을 사이킷런에서 train_test_split() 함수를 이용하면 간단하게 훈련 데이터와 테스트 데이터를 나눌 수 있다.

-

-```

-from sklearn.model_selection import train_test_split

-train_input, test_input, train_target, test_target = train_test_split(fish_data, fish_target, random_state = 42)

-print(train_input, test_input, train_target, test_target)

-```

-

-return 순서로는 train_input(훈련 데이터), test_input(테스트 데이터), train_target(훈련 라벨), test_target(테스트 라벨) 순이다.

-

-#### Kneighbors 확인하기

-

-데이터 시각화

-

-```

-kn = KNeighborsClassifier()

-# train

-kn.fit(train_input, train_target)

-# test

-kn.score(test_input, test_target)

-# sample predict

-print(kn.predict([[25,150]]))

-plt.scatter(train_input[:, 0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-plt.show()

-```

-

-```

-# 최근접 이웃의 거리 및 index

-distances, indexes = kn.kneighbors([[25, 150]])

-print(indexes)

-print(distances)

-```

-

-kneighbors 를 이용하면 해당 샘플의 최근접 이웃과 그 거리 값을 얻을 수 있다.

-

-```

-plt.scatter(train_input[:, 0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-# 최근접 이웃 표시

-plt.scatter(train_input[indexes,0], train_input[indexes,1], marker='D')

-plt.show()

-```

-

-최근접 이웃을 확인했을 때 이상한 점을 확인할 수 있을 것이다. knn은 기본적으로 거리를 계산하는데 x축과 y축의 단위(스케일)가 다르기 때문에 이러한 문제가 발생했다. 그렇기 때문에 우리는 두 특성의 값을 일정한 기준으로 맞춰야 한다. 이를 데이터 전처리라 한다.

-

-데이터 전처리에서 많이 사용하는 방법 중 하나는 표준점수이다.

-

-> 표준 점수 = 데이터 값 - 평균 / 표준 편차

-

-표준 점수를 이용하여 데이터 전처리를 진행해보자.

-

-Numpy 의 평균, 표준편차 함수를 이용하여 값을 구한다.

-

-```

-#평균, 표준편차

-mean = np.mean(train_input, axis=0)

-std = np.std(train_input, axis=0)

-

-print(mean, std)

-```

-

-```

-# 전처리 데이터

-train_scaled = (train_input - mean) / std

-```

-

-Numpy의 브로드 캐스팅으로 기존 데이터를 표준 점수로 바꿔준다.

-

-이를 시각화 해보자.

-

-```

-new_sample_scaled = ([25, 150] - mean) / std

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1])

-plt.show()

-```

-

-x축과 y축의 스케일이 변경된 것을 확인할 수 있다.

-

-이제 최근접 이웃을 확인해보자.

-

-```

-distances, indexes = kn.kneighbors([new_sample_scaled])

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1], marker='^')

-plt.scatter(train_scaled[indexes, 0], train_scaled[indexes, 1], marker='D')

-plt.show()

-```

-

-이제 우리가 생각했던 것처럼 최근접 이웃을 선택한 것을 확인할 수 있다.

-

----

-

-### 6\. 결정경계

-

-가능한 모든 테스트 포인트의 예측을 xy 평면에 나타내어 각 포인트가 속한 클래스에 따라 평면에 색을 칠한다. 이를 결정 경계라 한다.

-

-```

-import mglearn

-mglearn.plots.plot_2d_separator(kn, train_scaled, fill=True, eps=0.5, alpha=0.5)

-mglearn.discrete_scatter(train_scaled[:,0], train_scaled[:,1], train_target)

-plt.scatter(new_sample_scaled[0], new_sample_scaled[1], marker='D')

-plt.show()

-```

-

-\* colab 에서 mglearn 을 import 하는 방법이 궁금하면 다음 [글](https://noapps-code.tistory.com/202)을 참고하길 바란다.

-

----

-

-### 7\. 최적의 k 찾기

-

-```

-# 훈련 정확도와 테스트 정확도를 저장할 리스트 선언

-training_accuracy = []

-testing_accuracy = []

-

-# neighbor 1~37 세팅

-neighbor_settings = range(1,37)

-for n_neighbor in neighbor_settings:

- kn = KNeighborsClassifier(n_neighbors=n_neighbor)

- kn.fit(train_input, train_target)

- training_accuracy.append(kn.score(train_input, train_target))

- testing_accuracy.append(kn.score(test_input, test_target))

-plt.plot(neighbor_settings, training_accuracy, label = '훈련 정확도')

-plt.plot(neighbor_settings, testing_accuracy, label = '테스트 정확도')

-plt.show()

-print(f'훈련 데이터에서 최적의 k 는 {training_accuracy.index(max(training_accuracy)) + 1}')

-print(f'테스트 데이터에서 최적의 k 는 {testing_accuracy.index(max(training_accuracy)) + 1}')

-```

diff --git "a/week1/1\355\214\200_\354\236\245\354\244\200\354\230\244.md" "b/week1/1\355\214\200_\354\236\245\354\244\200\354\230\244.md"

deleted file mode 100644

index c1e40d1..0000000

--- "a/week1/1\355\214\200_\354\236\245\354\244\200\354\230\244.md"

+++ /dev/null

@@ -1,26 +0,0 @@

-**인공지능이란?**

-사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템

-

->Ex1) 강인공지능 : 사람과 비슷한 인공지능

-

->Ex2) 약인공지능 : 사람의 일을 보조하는 인공지능

-

-**인공지능의 학습**

->1. 머신러닝 : 자동으로 데이터에서 규칙 학습하는 알고리즘 연구 분야

-

->2. 딥러닝 : 머신러닝 알고리즘 중 심층신경망을 기반으로 한 방법

-

-##데이터 시각화

-1. 라이브러리 : matplotlib.pyplot을 사용.

-2. 내장 함수 : scatter() 산점도를 그리는 함수, xtable() x축의 변수를 설정하는 함수, ytable() y축의 변수를 설정하는 함수, show() 그래프를 출력하는 함수.

-

-##알고리즘

-1. 라이브러리 : sklearn.neighobrs 중에서 KNeighborsClassifier를 사용.

-2. 설명 : 근접한 데이터를 보고 다수를 차지하는 것을 정답으로 사용하는 머신러닝.

-3. 사용법 : KNeighborsClassifier(n_neighobrs=a) 근접한 a개의 데이터를 바탕으로 판단함.

-

-##머신러닝 구현하기

-1. 데이터 : 지도 학습 기준, 훈련 데이터와 테스트 데이터가 필요하며 데이터에 샘플이 올바르게 섞여 있지 않을 경우 샘플링 편향이 발생할 수 있다. *데이터는 사이킷런의 train_test_split을 이용하여 비율에 맞게 훈련과 테스트 데이터로 나눌 수 있다.*

-2. 사용 함수 : fit()을 이용하여 훈련 데이터를 학습 시키고 score를 통해 정확도를 출력하며 predict()를 이용해 테스트 데이터를 판별한다.(이진 분류의 경우)

-3. 시각화 : 산점도를 보면 x와 y의 범위가 다름을 알 수 있다. 따라서 데이터 전처리를 통해 특성값을 일정하게 맞춰주어야한다.

-

diff --git "a/week1/2\355\214\200_\352\271\200\354\203\201\353\257\274.md" "b/week1/2\355\214\200_\352\271\200\354\203\201\353\257\274.md"

deleted file mode 100644

index 8f17256..0000000

--- "a/week1/2\355\214\200_\352\271\200\354\203\201\353\257\274.md"

+++ /dev/null

@@ -1,91 +0,0 @@

-# 발표 1주차

-

----

-

-발표자 : 서현빈

-

-일자 : 2022-03-17

-

----

-

-## 내용 정리

-

-### 인공지능이란?

-

-- **인공지능** : 사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템

-

-뇌의 뉴런의 개념으로 부터 출발하여 퍼셉트론 그리고 지금의 머신러닝에 이르기까지 점점 발전해옴

-

-대표적인 인물로는 프랑크 로젠블라트 등이 있다.

-

-### 기본적인 머신러닝(빙어 vs 도미)

-

-- 흔히들 사람들은 도미와 빙어를 길이와 무게만으로 분류 가능하다.

-

-- 마찬가지로 이 문제를 산점도를 바탕으로 한 그림으로 그려 해결해볼 수 있다.

-

- ```python

- import matplotlib.pyplot as plt //그래프를 그리는 패키지

-

- plt.scatter(bream_length, bream_weight) //산점도를 그리는 함수

-

- plt.xtable('length')

-

- plt.ylable('weight)')

-

- plt.show()

-

- //도미, 빙어의 데이터를 바탕으로 산점도 그래프를 그림

-

- plt.scatter(bream_length, bream_weight)

-

- plt.scatter(smelt_length, smelt_weight)

-

- plt.xlabel('length')

-

- plt.ylabel('weight')

-

- plt.show()

- ```

-

-

-학습 데이터를 통한 2차원 데이터를 제작하고 KNeighborsClassifier클래스의 fit()메서드로 훈련을 시켜보자

-

-k-최근접 이웃 알고리즘을 이용하는 것으로 새로운 물고기가 어느분포에 가까이 있냐에 따라 물고기의 종류를 결정한다.

-

-### 머신러닝 기초

-

-- 지도학습 : 훈련하기 위한 데이터와 정답(지도자)가 존재하는 특성을 가지는 학습

- - 훈련 데이터와 평가 데이터가 완전히 똑같지 않도록 설정해야 한다.

- - 그러나 데이터를 분류할 때 랜덤으로 뽑도록 해야한다.( 샘플링 편향 방지 )

-

-- 비지도 학습 : 지도자 없이 데이터의 분포 파악 또는 변형에 초점을 맞추는 학습

-

-### 전처리 기초

-

-- numpy : 데이터의 전처리에 주로 이용되는 라이브러리

-

- ```python

- import numpy as np

- ```

-

-- 넘파이의 np.column_stack()을 이용해 전달받은 튜플을 넘파이 배열로 변환해줌.

-

- ```python

- np.column_stack(([1,2,3], [4,5,6]))

- ```

-

-- 넘파이의 np.concatenate(), np.ones, np.zeros를 통해 타깃 데이터를 생성함.

- ```python

- fish_target= np.concatenate((np.ones(35), np.zeros(14)))

- ```

-

-- np.mean은 평균을 계산하고, np.std는 표준편차를 계산함.

- ```python

- mean = np.mean(train_input, axis=0)

- std = np.std(train_input, axis=0)

- ```

-

-표준점수 = (원본 – 평균)/표준편차 train_scaled = (train_input - mean) / std

-

-테스트 세트로 평가할 때도, 샘플을 훈련 세트와 동일한 평균과 표준편차로 변환해야 평가 가 능하고, 새로운 샘플도 동일함

\ No newline at end of file

diff --git "a/week1/2\355\214\200_\353\202\250\354\234\240\354\260\254.md" "b/week1/2\355\214\200_\353\202\250\354\234\240\354\260\254.md"

deleted file mode 100644

index 4abb3a6..0000000

--- "a/week1/2\355\214\200_\353\202\250\354\234\240\354\260\254.md"

+++ /dev/null

@@ -1,22 +0,0 @@

-# 회귀 알고리즘과 모델 규제

-## 회귀 알고리즘

-회귀 알고리즘은 **어떤 숫자를 예측**하는데 주로 사용된다

-- K-최근접 이웃 회귀 알고리즘

-- 선형 회귀 알고리즘

-- 다항 회귀 알고리즘

-## K-최근접 이웃 회귀 알고리즘

-- 분류와 똑같이 예측하려는 샘플에 가장 가까운 샘플 k개를 선택하여 이웃한 샘플의 수치들의 평균을 구해서 샘플의 수치를 예상

-- 하지만 훈련 데이터의 범위를 넘어가는 수의 경우 정확도 낮아진다.

-## 선형 회귀 알고리즘

-- 특성이 하나인 경우, 직선을 이용하여 학습한다.

-## 다항 회귀 알고리즘

-- 다항식을 활용하여 선형 회귀를 한다

-## 과소적합과 과대 적합

-### 과소적합

-- 훈련세트 보다 테스트세트의 점수가 높거나 두 점수가 모두 낮음

-- 모델이 너무 단순하거나 훈련 세트를 통해 적절히 훈련되지 않음

-### 과대적합

-- 훈련세트가 테스트에 비해 점수가 너무 큼

-- 모델이 훈련 세트에만 적합해짐

-> 과소적합이나 과대적합이 발생할 때에는 적절한 모델의 수정이 요구됨

-- 다중 회귀는 2개 이상의 특성을 사용하여 모델을 형성해 과소적합 문제 해결에 도움을 받는다.

diff --git "a/week1/2\355\214\200_\354\234\244\355\230\225\354\204\234.md" "b/week1/2\355\214\200_\354\234\244\355\230\225\354\204\234.md"

deleted file mode 100644

index 828e37a..0000000

--- "a/week1/2\355\214\200_\354\234\244\355\230\225\354\204\234.md"

+++ /dev/null

@@ -1,11 +0,0 @@

-# 혼공머신 1주차

-## 인공지능

-인공지능 : 사람처럼 학습하고 추론하는 컴퓨터 시스템

-### 머신러닝. 자동으로 데이터에서 규칙 학습하는 알고리즘 분야

-- 딥러닝: 인공신경망을 기반으로한 머신러닝 알고리즘

-- 지도 학습: 훈련데이터와 정답데이터 활용

-- 비지도 학습: 입력데이터만 사용해서 학습. 데이터 파악 및 변형에 유리

-## k-최근접 이웃 알고리즘 활용 머신러닝

-k-": 근접한 데이터를 보고 다수를 차지하는 것을 정답으로함

-- 무게, 길이의 데이터를 합쳐 리스트화함.

-- 사이킷런을 사용하기 위해 2차원 리스트로 변환

diff --git "a/week1/3\355\214\200_\352\271\200\353\217\231\354\227\260.md" "b/week1/3\355\214\200_\352\271\200\353\217\231\354\227\260.md"

new file mode 100644

index 0000000..30d74d2

--- /dev/null

+++ "b/week1/3\355\214\200_\352\271\200\353\217\231\354\227\260.md"

@@ -0,0 +1 @@

+test

\ No newline at end of file

diff --git "a/week1/3\355\214\200_\352\271\200\355\225\234\352\262\260.md" "b/week1/3\355\214\200_\352\271\200\355\225\234\352\262\260.md"

deleted file mode 100644

index 2f139fa..0000000

--- "a/week1/3\355\214\200_\352\271\200\355\225\234\352\262\260.md"

+++ /dev/null

@@ -1,38 +0,0 @@

-# 나의 첫 머신러닝

-## 인공지능과 머신러닝, 딥러닝

-인공지능 : 사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스탬을 만드는 기술

-머신러닝 : 규칙을 일일이 프로그래밍하지 않아도 자동으로 데이터에서 규칙을 학습하는 알고리즘을 연구하는 분야

-딥러닝 : 머신러닝 알고리즘 중에 인공 신경망을 기반으로 한 방법들을 통칭

-## 코랩과 주피터 노트북

-코랩 : 구글 계정이 있으면 누구나 사용할 수 있는 웹 브라우저 기반의 파이썬 코드 실행 환경

-노트북 : 코드, 코드 실행 겨로가, 문서 모두 저장 가능

-구글 드라이브 : 구글이 제공하는 클라우드 파일 저장 서비스

-텍스트 셀에는 마크다운 사용 가능

-## 마켓과 머신러닝

-특성 : 데이터를 표현하는 하나의 성질

-훈련 : 머신러닝 알고리즘이 데이터에서 규칙을 찾는 과정

-k-최근접 이웃 알고리즘 : 가장 간단한 머신러닝 알고리즘. 전체 데이터를 메모리에 가지고 있는다.

-모델 : 알고리즘이 구현된 객체

-정확도 : 정확히 맞힌 개수/전체 데이터 개수

-1. matplotlib

-- scatter() : 산점도 그리기

-2. scikit-learn

-- KNeighborsClassifier() : k-최근접 이웃 분류 모델을 만드는 사이킷런 클래스

-- fit() : 사이킷런 모델 훈련

-- predict() : 모델 훈련 및 예측

-- score() : 훈련된 사이킷런 모델의 성능 측정

-# 데이터 다루기

-## 훈련 세트와 테스트 세트

-지도 학습 : 입력과 타깃을 전달하여 모델을 훈련한 다음 새로운 데이터를 예측하는 데 활용

-비지도 학습 : 타깃 데이터 X. 입력 데이터에서 어떤 특징을 찾는 데 주로 활용

-1. numpy

-- seed() : 난수를 생성하기 위한 정수 초깃값 지정

-- arrange() : 일정한 간격의 정수 또는 실수 배열 만들기

-- shuffle() : 주어진 배열 랜덤하게 섞기

-## 데이터 전처리

-데이터 전처리 : 머신러닝 모델에 훈련 데이터를 주입하기 전에 가공하는 단계

-표준점수 : 훈련 세트의 스케일을 바꾸는 대표적인 방법 중 하나

-브로드캐스팅 : 크기가 다른 넘파이 배열에서 자동으로 사칙 연산을 모든 행이나 열로 확장하여 수행하는 기능

-1. scikit-learn

-- train_test_split() : 훈련 데이터를 훈련 세트와 테스트 세트로 나눔

-- kneighbors() : k-최근접 이웃 객체의 메서드

\ No newline at end of file

diff --git "a/week1/3\355\214\200_\354\235\264\354\236\254\355\235\240.md" "b/week1/3\355\214\200_\354\235\264\354\236\254\355\235\240.md"

index 6ba35b1..cb13698 100644

--- "a/week1/3\355\214\200_\354\235\264\354\236\254\355\235\240.md"

+++ "b/week1/3\355\214\200_\354\235\264\354\236\254\355\235\240.md"

@@ -34,7 +34,7 @@

**노트북**은 프로그램 안에서 텍스트와 프로그램 코드를 자유롭게 작성할 수 있는 에디터 입니다.

**셀**은 노트북에서 실행할 수 있는 최소 단위입니다. 셀 안에 있는 내용을 한번에 실행하고 그 결과를 노트북으로 나타냅니다. 기존에 실행된 셀 내용이 다른 셀에서 실행할때 영향을 끼친다는 것이 노트북의 큰 특징입니다.

-###### 구글 코랩

+######구글 코랩

**구글 코랩**은 주피터 노트북을 커스터마이징 웹 브라우저에서 무료로 파이썬 프로그램을 테스트하고 저장할 수 있는 서비스 입니다. 클라우드 기반의 주피터 노트북 개발 환경을 가지고 있어 자신의 컴퓨터의 사양이 좋지 않아도 프로그램을 돌릴 수 있어 유용합니다.

@@ -88,7 +88,7 @@ predict( ) 메서드는 새로운 데이터의 정답을 예측하는 메소드

하지만 모든 데이터를 훈련을 넣고 모든 데이터를 넣고 테스트 해보는 것은 학습이 되어있는 데이터를 다시 처리하는 것 뿐이므로 성능을 제대로 평가 할 수 없습니다.

그래서 우리는 이 데이터를 훈련하는 데이터(train set)와 테스트하는 데이터(test set)로 나누어 모델 평가를 해야 합니다.

-###### 샘플링 편향

+######샘플링 편향

훈련 데이터와 테스트 데이터에는 다른 특징을 가지는 데이터들이 골고루 섞여져 있어야 합니다.

골고루 섞여져 있지 않은 경우, 샘플링이 한쪽으로 치우치게 되어 훈련을 할 때 한쪽에 편향된 결과가 만들어져 정확도에 영향을 끼칠수 있습니다. 이를 **샘플링 편향**이라고 부릅니다.

@@ -132,4 +132,4 @@ train_input, test_input, train_target, test_target = train_test_split(some_data,

````python

mean = np.mean(train_input, axis=0) #행을 따라(axis=0) 각 열의 평균값을 계산합니다.

std = np.std(trian_input, axis=0) #행을 따라(axis=0) 각 열의 표준편차를 계산합니다.

-````

+````

\ No newline at end of file

diff --git "a/week1/3\355\214\200_\354\241\260\353\252\205\352\265\254.md" "b/week1/3\355\214\200_\354\241\260\353\252\205\352\265\254.md"

deleted file mode 100644

index 1e12c66..0000000

--- "a/week1/3\355\214\200_\354\241\260\353\252\205\352\265\254.md"

+++ /dev/null

@@ -1,20 +0,0 @@

- 1주차에는 구글 코랩의 기본적인 사용법과 k-최근접 이웃 알고리즘을 공부했습니다.

-교재에서 배운 내용을 학습하는 것을 기본적으로 구글 코랩이라는 곳에서 하는데

-코드를 구글 클라우드에서 실행하기 때문에 본인이 사용하는 pc의 영향을 받지 않지만

-할당받은 메모리 안에서 코드 실행이 이루어져야하기 때문에 조금의 제한사항이 있습

-니다. 이 책의 커리큘럼을 따라가는데에는 무리가 없다고 합니다.

- 첫 머신러닝은 k-최근접 알고리즘을 학습하기 위해 샤이킷런에서 KNeighborsClassifier

-을 import하여 사용합니다. k-최근접 알고리즘을 이용하게 해주는 머신러닝 관련 class인

-걸로 이해하고 있습니다. KNeighborsClassifier(이하 kn)는 지도 학습에 해당하는데 이

-지도학습은 input과 target을 필요로 합니다. input에 대응하는 target을 학습한 후

-test set로 kn이 학습이 잘 되었는지 결정계수(Ch. 3)를 점수로 매깁니다. fit 명령어를

-이용하여 train하고 score 명령어로 점수를 매깁니다. 점수가 1에 가까울수록 훈련이

-잘 되었다고 볼 수 있습니다.

- kn은 제시된 데이터가 도미냐 빙어냐를 판별하기 위해 가장 가까운 이웃 5개를 그래프

-상 거리를 기준으로 선발하여 그 중 많은 쪽으로 판별합니다. 하지만 여기서 무게와

-너비 단위가 다르다는 이유로 산점도 그래프상으로 빙어인 데이터를 도미로 오판정하게

-됩니다. 이를 계기로 데이터 전처리라는 걸 공부하게 됩니다.

- 데이터 전처리는 모든 데이터를 평등하게 만들어줍니다. 여기서 배운 데이터 전처리는

-표준 점수라고 하는 것으로, {(데이터)-(평균)}/(표준편차)로 계산합니다. 이 표준 점수는

-train_input을 기준으로 구한 평균과 표준편차를 이용하여 train_input, test_input 둘 다를

-전처리해주어야 합니다. 이 과정을 통해 x축과 y축의 scale 문제가 해소될 수 있습니다.

\ No newline at end of file

diff --git "a/week1/4\355\214\200_week2_\354\243\274\354\227\260\354\247\204.md" "b/week1/4\355\214\200_week2_\354\243\274\354\227\260\354\247\204.md"

deleted file mode 100644

index fc2e6dd..0000000

--- "a/week1/4\355\214\200_week2_\354\243\274\354\227\260\354\247\204.md"

+++ /dev/null

@@ -1,205 +0,0 @@

-# **회귀 알고리즘과 모델 규제**

-## **K-최근접 이웃 회귀**

----

-* 주변 샘플 k개를 선택해 타깃값을 평균내서 타깃값을 예측하는 방법

-* 사이킷런 훈련 세트는 2차원 배열이어야 함

-```python

-test_array = np.array([1, 2, 3, 4])

-

-test_array = test_array.reshape(2, 2)

-

-print(test_array.shape)

-```

-1. 처음 [1, 2, 3, 4] 의 경우 크기는 (4, )이다. ( 1차원 배열 )

-

-2. reshape( )를 사용하면 크기가 (2, 2)로 변경 된다. ( 2차원 배열 )

-

-3. reshape( -1, 1 )을 하면 첫 번째 크기를 나머지 원소 개수로 채우고, 두 번째 크기는 1이 된다.

-

-* **KNeighborsRegressor** : k - 최근접 이웃 회귀 알고리즘 구현 클래스

-```python

-from sklearn.neighbors import KNeighborsRegressor

-

-knr = KNeighborsRegressor()

-

-kn.fit(train_input, train_target)

-```

-

-## **결정계수 ( $R^2$ )**

----

-```python

-print(knr.score(test_input, test_target))

-```

-결과값으로 0.992809406100639가 나온다.

-

-* **결정계수 ( $R^2$ )** : 위 결과값

-

-$$

-R^2 = 1 - \frac{(타깃 - 예측)^2의 합 }{ (타깃 - 평균)^2의 합}

-$$

-이와 같이 결정계수를 구할 수 있다.

-> * 평균 = 타깃 값들의 평균

-> * 결정계수는 분산 이용한 모델평가지표

-> * 독립변수로 설명할 수 있는 분산 / 전체분산 과 같다

-> * 독립변수들이 종속변수들을 얼마나 설명하는가

-> * 1에 가까울수록 좋은 모델

-

-## **타깃과 예측한 값 차이 구하기**

----

-* **mean_absolute_error :** 타깃과 예측의 절댓값 오차 평균 반환

-```python

-from sklearn.metrics import mean_absolute_error

-

-test_prediction = knr.predict(test_input)

-

-mae = mean_absolute_error(test_target, test_prediction)

-```

-다음과 같이 사용한다.

-

-## **과대적합 vs 과소적합**

----

-### **과대적합**

-* 훈련 세트에서 점수가 굉장히 좋은데, 테스트 세트에서 점수가 굉장히 나쁜 경우

-* 훈련 세트에만 잘 맞는 모델

-

-### **과소적합**

-* 훈련 세트보다 테스트 세트 점수가 더 놓은 경우

-* 두 점수 모두 낮은 경우

-

-

-### **과소적합이 일어나는 이유 :**

-* 모델이 너무 단순하여 훈련 세트에 적절히 훈련되지 않은 경우

-* 훈련 세트와 테스트 세트의 크기가 매우 작기 때문

-

-### **과소적합 해결 방법**

-모델을 조금 더 복잡하게 만들면 된다. K-최근접 이웃 알고리즘의 경우 K를 줄이면 된다.

-

-## **선형회귀**

-___

-* 사이킷럿에 LinearRegression 클래스에서 선형 회귀 알고리즘 사용

-```python

-from sklenar.linear_model import LinearRegression

-

-lr = LinearRegression()

-

-lr.fit(train_input, train_target)

-

-print(lr.predict([[50]]))

-```

-다음과 같이 사용한다.

-

- * **coef_ :** 기울기 ( 계수, 또는 가중치라고도 불림 )

- * **intercept_ :** y절편

-

- ## **다항회귀**

- ---

- * 최적의 곡선 찾기

- * 2차 방정식 그래프 그리려면 길이 제곱이 훈련에 추가 되어야 함

-```python

-train_poly = np.column_stack((train_input ** 2, train_input))

-test_poly = np.column_stack((test_input ** 2, test_input))

-```

-* 어떤 그래프를 훈련하든지, 타깃값은 그대로 사용한다.

-

-```python

-lr = LinearRegression()

-lr.fit(train_poly, train_target)

-

-print([[50 ** 2, 50]])

-```

-## **다중 회귀**

----

-* 여러 개의 **특성**을 사용한 선형 회귀

-

-* **특성 공학 :** 기존의 특성을 사용해 새로운 특성을 뽑아내는 작업

- > ex) '농어 길이' x '농어 높이'를 새로운 특성으로 만들기

-

-## **판다스**

----

-* 데이터 분석 라이브러리

-* **넘파이와 달리** 인터넷에서 데이터 바로 다운로드해서 사용 가능

-* 데이터 프라임 넘파이 배열로 바꾸는 거 가능

-* read_csv( '주소' ) 로 데이터 프라임 만들고, to_numpy()

-

-```python

-import pandas as pd

-

-df = pd.read_csv('https://bit.ly/perch_csv_data')

-perch_full = df.to_numpy()

-print(perch_full)

-# [[8.4, 2.11, 1.41],

-# [13.7, 3.53, 2. ]]

-# 위와 같이 여러 특성을 포함한 numpy로 바뀐다.

-```

-

-## **사이킷런 변환기**

----

-* **변환기:** 특성을 만들거나 전처리해주는 클래스

- > ex) PolynomialFeatures

-* **include_bias = False :** transform 할 때 1을 자동으로 추가하는 것을 방지

-* **transform() :** 특성 각자 그대로, 각자 제곱한 값, 서로서로 곱한 값 모두 포함

-* **polynomialFeatures(degree = 5) :** 5제곱까지 특성 만듦

-

-```python

-from sklearn.preprocessing import PolynomialFeatures

-

-poly = PolynomialFeatures()

-

-poly.fit([[2, 3]]) #훈련 해야 변환 가능

-print(poly.transform([[2,3]]))

-# [[1,2,3,4,6,9]] 가 나옴.

-# 2개 특성이 6개로 바뀜.

-```

-

-## **규제**

----

-* 훈련 세트에 과대적합되지 않도록 만드는 것

-* 선형 회귀 모델의 경우 특성에 곱해지는 계수 작게 만들기

-* 선형 회귀 모델에 규제 적용할 때, 계수 깂 크기가 특성마다 많이 다르면 공정한 제어 불가능하므로 정규화 필요

-* **StandardScaler :** 특성 표준점수로 바꿔주는 변환기

-

-```python

-from sklearn.preprocessing import StandardScaler

-

-ss = StandardScaler()

-ss.fit(train_poly)

-

-train_scaled = ss.transform(train_poly)

-test_scaled = ss.transform(test_poly)

-```

-

-### **Alpha**

-* Alpha는 매개변수로 규제 강도 조절

-

-* Alpha 값이 **크면** 규제 커지고 **과소적합** 유도

-* Alpha 값이 **작으면** 규제 작아지고 **과대적합** 유도

-* **하이퍼파라미터 :** 모델이 학습할 수 없고 사람이 알려줘야 하는 파라미터

-

-

-### **릿지 회귀**

-* 선형 회귀 모델에 규제를 추가한 모델

-* 계수를 제곱한 값을 기준으로 규제

-```python

-from sklearn.linear_model import Ridge

-

-ridge = Ridge()

-ridge.fit(train_scaled, test_scaled)

-```

-이와 같이 사용한다.

-

-### **라쏘 회귀**

-* 계수의 절댓값을 기준으로 규제 적용

-* 계수 크기 0으로 만들기 가능

-```python

-from sklearn.linear_model import Lasso

-

-lasso = Lasso()

-lasso.fit(train_scaled, test_scaled)

-```

-

-

-

-

-

-

-

diff --git "a/week1/4\355\214\200_\353\260\260\354\227\260\354\232\261.md" "b/week1/4\355\214\200_\353\260\260\354\227\260\354\232\261.md"

deleted file mode 100644

index d2c6730..0000000

--- "a/week1/4\355\214\200_\353\260\260\354\227\260\354\232\261.md"

+++ /dev/null

@@ -1,109 +0,0 @@

-# [1주차 과제] 4팀 배연욱

-

----

-

-### Chapter 1. 나의 첫 머신러닝

-

----

-

-**인공지능(artificial intelligence, AI)**은 사람처럼 학습하고 추론할 수 있는 지능을 가진 시스템을 만드는 기술이다.

-

-**인공지능**

-

-* 강인공지능

-* 약인공지능

-

-

-**머신러닝(machine learning, ML)**은 규칙을 프로그래밍하지 않아도 자동으로 데이터에서 규칙을 학습하는 알고리즘을 연구하는 분야. Scikit-learn이 대표적인 라이브러리이다.

-

-**머신러닝**

-

-* 지도학습

- * 분류

- * 회귀

-* 비지도학습

-* 강화학습

-

-

-**딥러닝(deep learning, DL)**은 인공 신경망이라고도 하며, TensorFlow, PyTorch가 대표적인 라이브러리이다.

-

-

-**인공지능**

-

-* **머신 러닝**

- * **딥러닝**

-

----

-

-**코랩(Colab)**은 구글 계정이 있으면 누구나 사용할 수 있는 웹 브라우저 기반의 Python 코드 실행 환경이다.

-

-**텍스트 셀에 사용할 수 있는 마크다운**

-

-

----

-

-**특성**은 데이터를 표현하는 하나의 성질이다.

-

-

-머신러닝 알고리즘이 데이터에서 규칙을 찾는 과정을 **훈련**이라고 한다. Scikit-learn에서는 fit() 메서드가 하는 역할이다.

-

-

-**k-최근접 이웃 알고리즘**은 가장 간단한 머신러닝 알고리즘 중 하나이다. 사실 어떤 규칙을 찾기보다는 전체 데이터를 메모리에 가지고 있는 것이 전부이다.

-

-

-머신러닝 프로그램에서는 알고리즘이 구현된 객체를 **모델**이라고 부른다. 종종 알고리즘 자체를 모델이라고 부르기도 한다.

-

-

-**정확도**는 정확한 답을 몇 개 맞혔는지를 백분율로 나타낸 값이다. Scikit-learn에서는 0~1 사이의 값으로 출력된다.

-> 정확도 = (정확히 맞힌 개수) / (전체 데이터 개수)

-

----

-

-### Chapter 2. 데이터 다루기

-

----

-

-**지도 학습**은 입력과 타깃을 전달하여 모델을 훈련한 다음 새로운 데이터를 예측하는 데 활용한다. 1장에서부터 사용한 k-최근접 이웃이 지도 학습 알고리즘이다.

-

-

-**비지도 학습**은 타깃 데이터가 없다. 따라서 무엇을 예측하는 것이 아니라 입력 데이터에서 어떤 특지을 찾는 데 주로 활용한다.

-

-

-**훈련 세트**는 모델을 훈련할 때 사용하는 데이터이다. 보통 훈련 세트가 클수록 좋다. 따라서 테스트 세트를 제외한 모든 데이터를 사용한다.

-

-

-**테스트 세트**는 전체 데이터에서 20~30%를 테스트 세트로 사용하는 경우가 많다. 전체 데이터가 아주 크다면 15%만 덜어내도 충분할 수 있다.

-

----

-

-**데이터 전처리**는 머신러닝 모델에 훈련 데이터를 주입하기 전에 가공하는 단계를 말한다. 때로는 데이터 전처리에 많은 시간이 소모되기도 한다.

-

-**데이터 전처리**

-

-* 이상치(outliers) 제거

-* 결측값(missing values) 처리

- 1. 결측값이 있는 행 제거 (.dropna() 사용)

- 2. 결측값 보강 (imputation)

- * 평균값 또는 중앙값 또는 최빈값으로 대체

- * 예측값으로 대체

-* Feature Scaling

- * 정규화(normalization)

- * 표준화(standardization)

-

-

-**표준점수**는 훈련 세트의 스케일을 바꾸는 대표적인 방법 중 하나이다. 표준점수를 얻으려면 특성의 평균을 빼고 표준편차로 나눈다. 반드시 훈련 세트의 평균과 표준편차로 테스트 세트를 바꿔야 한다.

-

-

-**브로드캐스팅**은 크기가 다른 NumPy 배열에서 자동으로 사칙 연산을 모든 행이나 열로 확장항여 수행하는 기능이다.

-

----

-

-### 기타 발표 내용 정리

-

----

-

-**교차 검증**

-

-* Holdout method

-* Leave-one-out cross validation

-* k-fold cross validation

diff --git "a/week1/4\355\214\200_\354\243\274\354\227\260\354\247\204.md" "b/week1/4\355\214\200_\354\243\274\354\227\260\354\247\204.md"

deleted file mode 100644

index dfbd83d..0000000

--- "a/week1/4\355\214\200_\354\243\274\354\227\260\354\247\204.md"

+++ /dev/null

@@ -1,110 +0,0 @@

-# **나의 첫 머신러닝 & 데이터 다루기**

-## 1. 인공지능, 머신러닝, 딥러닝이란 무엇인가

--------

-* **인공지능**

- >사람처럼 학습하고 추론할 수 있는 지능을 가진 컴퓨터 시스템을 만드는 기술

-

-* **머신러닝**

- > 규칙을 일일이 프로그래밍하지 않아도 자동으로 데이터에서 규칙을 학습하는 알고리즘을 연구하는 분야

-

-* **딥러닝**

- >머신러닝 알고리즘 중에 인공신경망을 기반으로 한 방법들

-

-## 2. 머신러닝의 종류

----

-* **지도학습( Supervised Learning )**

-

- > 훈련 데이터로부터 하나의 함수를 유추해내기 위한 기계 학습의 한 방법

-

-* **비지도학습( Unsupervised Learning)**

- > 정답 라벨이 없는 데이터를 비슷한 특징끼리 군집화하여 새로운 데이터에 대한 결과를 예측하는 기계학습의 한 방법

-

-* **강화학습( Reinforcement Learning )**

- > 현재의 상태에서 어떤 행동을 취하는 것이 최적인지를 학습하는 기계학습의 한 방법

-

- ## 3. matplotlib

----

-- 과학계산용 그래프 그려주는 패키지

-- scatter( ) : 산점도 그려주는 함수

-```python

-import matplotlib.pyplot as plt

-

-plt.scatter(bream_length, bream_weight)

-```

-이와 같이 사용한다.

-

-## 4. K - 최근접 이웃 알고리즘

----

-* 주위 다른 데이터를 바탕으로 현재 데이터를 판단하는 알고리즘

- > 거리 기반이며, 기본적으로 가까운 5개 데이터 참고함

-

-* KNeighborsClassifier : 사이킷런에 패키지에서 k-최근접 알고리즘 구현한 클래스

-* kneighbors( ) : 이웃 데이터들 찾아서 이웃들까지 거리와 이웃 인덱스 반환

- > kneighbors( 데이터 )

-* fit( ) : 훈련시키는 메서드

- > fit( 인풋 데이터, 정답 ) 순으로 작성

-* score( ) : 모델 평가하는 메서드

- > score( 인풋 데이터, 정답 ) 순으로 작성

-* predict( ) : 새로운 데이터 정답 예측하는 메서드

- > predict( 데이터 )

-

-```python

-from sklearn.neighbors import KNeighborsClassifier

-

-kn = KNeighborsClassifier()

-kn.fit( fish_data, fish_target )

-kn.score( fish_data, fish_target )

-kn.predict( [[30, 600]] )

-```

-이와 같이 사용한다.

-

-## 5. 넘파이 ( numpy )

----

-* 배열 라이브러리로, 고차원 배열을 쉽게 만들 수 있으며 간편한 도구들이 많아 쉽게 조작 가능

-

-* array( ) : 파이썬 리스트를 넘파이 배열로 바꾸기

-* arange( num ) : 0 ~ ( num - 1 )까지 1씩 증가하는 인덱스 만들어주는 함수

-* random.shuffle( ) : 주어진 배열 무작위로 섞는 함수

-* column_stack( ) : 전달받은 리스트들 각각 하나씩 원소 꺼내서 붙이기

-* concatenate( ) : 첫번째 차원을 따라 배열 연결해주는 함수

-

-```python

-import numpy as np

-

-input_arr = np.array( fish_data )

-index = np.arange( 49 )

-np.random.suffle( index )

-

-fish_data = np.column_stack((fish_length, fish_weight))

-fish_target = np.concatenate((np.ones(35), np.zeros(14)))

-```

-이와 같이 사용한다.

-

-## 6. train_test_split

----

-* 리스트나 배열을 비율에 맞게 훈련 세트와 테스트 세트로 나눠줌

-* 기본적으로 25%가 테스트 세트로 가지만, stratify에 타겟 데이터를 전달하면 클래스 비율에 따라 데이터 나눔 가능

-

-```python

-from sklearn.model_selection import train_test_split

-

-train_input, test_input, train_target, test_target = train_test_split(fish_data, fish_target, stratify = fish_target, random_state = 42)

-```

-1. fish_data가 비율에 따라 train_input, test_input으로 나뉨

-2. fish_target이 비율에 따라 train_target, test_target으로 나뉨

-

-## 7. 데이터 전처리

----

-* 특성의 스케일이 달라서 어느 한 쪽이 거리에 영향을 많이 미칠 경우, 대표적으로 표준점수로 값 변환

-

-* 표준점수 ( z ) = ( 데이터 - mean ) / std

-* np.mean( ) : 평균 계산

-* np.std( ) : 표준편차 계산

-

-```python

-mean = np.mean( train_input, axis = 0 )

-std = np.std( train_input, axis = 0 )

-

-train_scaled = ( train_input - mean ) / std

-```

-이와 같이 사용힌다.

diff --git "a/week1/4\355\214\200_\354\265\234\355\203\234\354\230\201.md" "b/week1/4\355\214\200_\354\265\234\355\203\234\354\230\201.md"

deleted file mode 100644

index 8a3112d..0000000

--- "a/week1/4\355\214\200_\354\265\234\355\203\234\354\230\201.md"

+++ /dev/null

@@ -1,81 +0,0 @@

-import matplotlib.pyplot as plt#그래프 그리기

-import numpy as np#라이브러리 넘파이

-

-fish_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0,

- 31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0,

- 35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0, 9.8,

- 10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

-fish_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0,

- 500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0,

- 700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0, 6.7,

- 7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9] # 데이터

-

-

-fish_data = [[l,w] for l, w in zip(fish_length,fish_weight)]# 2d 로 데이터 정렬

-

-fish_target = [1]*35 + [0]*14 #정답 데이터를 만듦. 1은 도미 2는 빙어

-

-input_arr = np.array(fish_data)

-target_arr = np.array(fish_target) #넘파이로 변환

-

-from sklearn.neighbors import KNeighborsClassifier # KNeighborsClassifier 라이브러리 호출

-

-kn = KNeighborsClassifier()

-

-np.random.seed(42)

-index = np.arange(49)

-np.random.shuffle(index) #데이터를 섞음

-

-train_input = input_arr[index[:35]]

-train_target = target_arr[index[:35]]

-print(input_arr[13], train_input[0])

-test_input = input_arr[index[35:]]

-test_target = target_arr[index[35:]] #데이터를 나누어 학습 데이터와 테스트 데이터 셋을 만듦

-

-kn = kn.fit(train_input, train_target) #학습

-kn.score(test_input, test_target)#평가

-kn.predict(test_input)

-test_target

-fish_data = np.column_stack((fish_length, fish_weight))# 데이터 합체

-fish_target = np.concatenate((np.ones(35), np.zeros(14)))#타깃 데이터 생성

-from sklearn.model_selection import train_test_split

-train_input, test_input, train_target, test_target = train_test_split(

- fish_data, fish_target, stratify=fish_target, random_state=42) #데이터 분류. split()함수를 통해 간단하게 가능

-print(test_target)

-kn.fit(train_input, train_target)#학습

-kn.score(test_input, test_target)

-plt.scatter(train_input[:,0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show() #그래프 그리기

-distances, indexes = kn.kneighbors([[25, 150]])

-plt.scatter(train_input[:,0], train_input[:,1])

-plt.scatter(25, 150, marker='^')

-plt.scatter(train_input[indexes,0], train_input[indexes,1], marker='D')

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show()

-mean = np.mean(train_input, axis=0)

-std = np.std(train_input, axis=0) #거리를 표준화하기 위해 평균값과 분산을 구함

-print(mean, std)

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(25, 150, marker='^')

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show() #그래프화

-new = ([25, 150] - mean) / std# 표준화

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new[0], new[1], marker='^')

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show()

-kn.fit(train_scaled, train_target) #새로 학습시킴

-test_scaled = (test_input - mean) / std

-distances, indexes = kn.kneighbors([new])

-plt.scatter(train_scaled[:,0], train_scaled[:,1])

-plt.scatter(new[0], new[1], marker='^')

-plt.scatter(train_scaled[indexes,0], train_scaled[indexes,1], marker='D')

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show()#데이터 전처리를 통해 더 확실한 정답을 구함

\ No newline at end of file

diff --git "a/week1/5\355\214\200_\352\271\200\353\217\231\354\232\260.md" "b/week1/5\355\214\200_\352\271\200\353\217\231\354\232\260.md"

deleted file mode 100644

index 26ed755..0000000

--- "a/week1/5\355\214\200_\352\271\200\353\217\231\354\232\260.md"

+++ /dev/null

@@ -1,114 +0,0 @@

-# Chap 1, 2

-

-## k-Nearest Neighbors

-

-### key words

-

-* 특성: 데이터를 표현하는 하나의 성질

-* 훈련: 머신러닝 알고리즘이 데이터의 규칙을 찾는 과정

-* k-Nearest Neighbors: 머신러닝 알고리즘 중 하나

-* 모델: 머신러닝 프로그램에서 알고리즘이 구현된 객체

-* 정확도: 머신러닝 알고리즘이 답을 맞힌 비율

-* matplotlib: 그래프와 차트를 그리는 모듈

-* scikit-learn: 머신러닝, 딥러닝 모델을 만드는 모듈

----

-```python

-bream_length = [25.4, 26.3, 26.5, ...]

-bream_weight = [242.0, 290.0, 340.0, ...]

-

-import matplotlib.pyplot as plt

-

-plt.scatter(bream_length, bream_weight)

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show()

-

-smelt_length = [9.8, 10.5, 10.6, ...]

-smelt_weight = [6.7, 7.5, 7.0, ...]

-

-plt.scatter(bream_length, bream_weight)

-plt.scatter(smelt_length, smelt_weight)

-plt.xlabel('length')

-plt.ylabel('weight')

-plt.show()

-```

-1. 도미와 빙어 데이터 준비

-2. matplotlib 모듈 불러오기

-3. matplotlib의 산점도 함수를 이용하여 데이터 분포 확인

----

-```python

-length = bream_length+smelt_length

-weight = bream_weight+smelt_weight

-

-fish_data = [[l, w] for l, w in zip(length, weight)]

-

-fish_target = [1]*35 + [0]*14

-

-from sklearn.neighbors import KNeighborsClassifier

-

-kn = KNeighborsClassifier()

-